HuggingFace、GitHub、Nvidia NGCと呼ばれるNvidiaの企業向けウェブポータル、オープンソースまたは商用AIコードのさまざまなソースなどの一般的なリポジトリに接続することで、Nvidia AI Workbenchは開発者に一元化されたスペースを提供する。

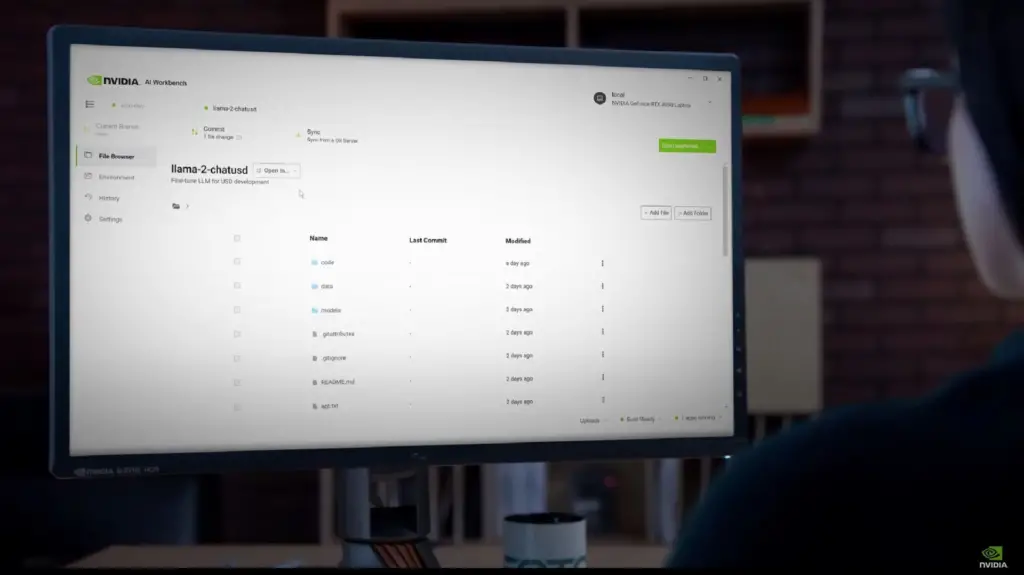

Nvidia AI Workbenchが発表され、ジェネレーティブAIの創造と展開に変革をもたらす可能性が示された。Nvidia AI Workbenchを活用することで、開発者はより合理的なプロセスを期待することができ、PCやワークステーションなどの異なるNvidia AIプラットフォームで作業することができる。

AIコンテンツが市場に溢れることはないかもしれないが、Nvidia AI WorkbenchがAI開発と統合への道のりをよりユーザーフレンドリーにするものであることは間違いない。

Nvidia AI Workbenchは何を提供するのか?

Nvidiaは、ロサンゼルスで毎年開催されるSIGGRAPH(Special Interest Group on Computer Graphics and Interactive Techniques)カンファレンスでAIWorkbenchを発表し、開発者のローカルマシン上で動作するように設計された使いやすいプラットフォームを発表した。

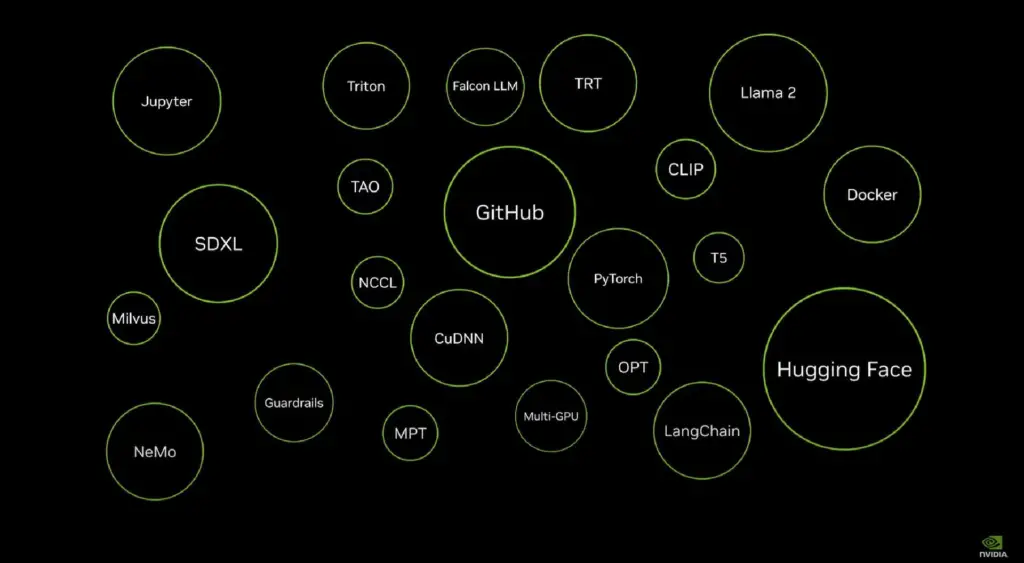

HuggingFace、GitHub、Nvidia NGCと呼ばれるNvidiaの企業向けウェブポータル、オープンソースまたは商用AIコードのさまざまなソースといった一般的なリポジトリに接続することで、Nvidia AI Workbenchは開発者に一元化されたスペースを提供する。

開発者は、複数のブラウザ・ウィンドウをナビゲートすることなくこれらのリソースにアクセスすることができ、好みやニーズに応じてモデル・コードをインポートしたりカスタマイズしたりするプロセスが簡素化されます。

最近の発表で同社は、Nvidia AI Workbenchが、開発者が存在する何十万もの事前学習済みAIモデルと対話する方法に革命をもたらす可能性があると強調した。従来、これらのモデルをカスタマイズするのは複雑な作業だったが、Nvidia AI Workbenchはそのプロセスを大幅に簡素化するように設計されている。

この新しいツールを使用することで、開発者は生成AIを簡単に微調整して実行することができ、必要不可欠なエンタープライズ品質のモデルすべてにアクセスすることができます。サポートは、Nvidia独自のAIプラットフォームや、GitHubやHugging Faceのような著名なオープンソースリポジトリから、様々なフレームワーク、ライブラリ、SDKにまで及ぶ。

Nvidia AI Workbenchはカスタマイズだけでなく、複数のプラットフォーム間での共有も容易にしている。PCやワークステーションでNvidia RTXグラフィックカードを使用している開発者は、これらの生成モデルをローカルで管理することができます。必要に応じて、データセンター・リソースやクラウド・コンピューティングへのスケーラビリティもスムーズに移行できる。

「Nvidia AI Workbenchは、組織横断的なチームが、現代のビジネスでますます不可欠になっているAIベースのアプリケーションを作成するための簡素化された経路を提供します。

Nvidia AI Enterprise 4.0もリリースされました。

Nvidia AI Workbenchとともに、NvidiaはNvidia AI Enterpriseソフトウェアプラットフォームの第4版を発表した。このプラットフォームは、企業環境におけるジェネレーティブAIの採用とカスタマイズに不可欠なツールを提供するために特別に設計されている。

Nvidia AI Enterprise 4.0は、安定したAPI接続に支えられ、ジェネレーティブAIモデルをさまざまな業務にシームレスかつ安全に統合することを目的としている。

新たに発表されたプラットフォームは、クラウドネイティブ対応と大規模言語モデル(LLM)アプリケーションの包括的サポートを実現するNvidia NeMoや、本番環境でのデプロイを自動化・強化するNvidia Triton Management Serviceなど、さまざまなツールを備えている。

さらに、クラスタ管理ソフトウェアであるNvidia Base Command Manager Essentialsが統合され、データセンター、マルチクラウド、ハイブリッド環境におけるパフォーマンスの最適化を支援する。

今回の発表では、ServiceNow、Snowflake、Dell Technologiesといった業界大手との協力関係も強調され、幅広いAI新製品への道が開かれ、AI領域でイノベーションをリードするNvidiaのコミットメントがさらに示された。

NvidiaのAI市場への参入はうまく同期しているようで、Workbenchだけでなく、ゲーム・アプリケーション用のNvidia ACEなど他のツールも提供している。ChatGPTのようなジェネレーティブAIモデルの人気が高まっていることから、多くの開発者はNvidiaの包括的でユーザーフレンドリーなソリューションに魅力を感じていることだろう。

しかし、ジェネレーティブAIの使用は時に疑わしいアプリケーションにつながる可能性があるため、このアクセスのしやすさは一定の不確実性ももたらす。この分野におけるNvidiaのイノベーションの広範な意味合いは、まだ完全に理解されていない。