En se connectant à des référentiels populaires tels que HuggingFace, GitHub, le portail web d’entreprise de Nvidia appelé NVIDIA NGC et diverses sources de code d’IA open source ou commercial, le Nvidia AI Workbench offre un espace centralisé pour les développeurs.

Le Nvidia AI Workbench a été dévoilé, signalant un moment potentiellement transformateur dans la création et le déploiement de l’IA générative. En profitant du Nvidia AI Workbench, les développeurs peuvent s’attendre à un processus plus rationalisé, leur permettant de travailler sur différentes plateformes Nvidia AI, telles que les PC et les stations de travail.

Même s’il n’inondera pas le marché de contenu sur l’IA, il ne fait aucun doute que le Nvidia AI Workbench est positionné pour faire du développement et de l’intégration de l’IA une expérience plus conviviale.

Qu’est-ce que le Nvidia AI Workbench a à offrir ?

Nvidia a annoncé AI Workbench lors de la conférence annuelle SIGGRAPH (Special Interest Group on Computer Graphics and Interactive Techniques) à Los Angeles, dévoilant une plateforme facile à utiliser conçue pour fonctionner sur la machine locale d’un développeur.

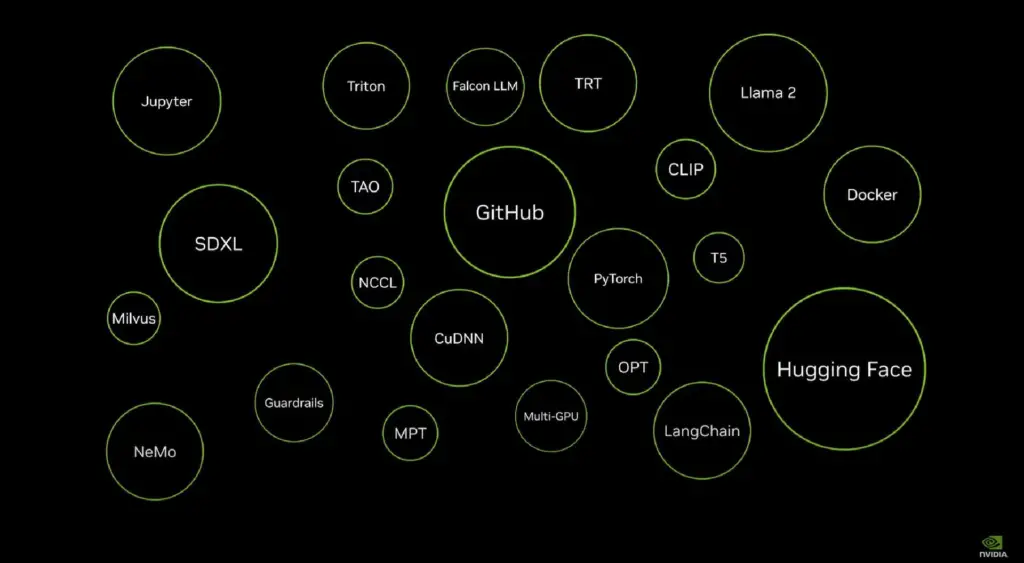

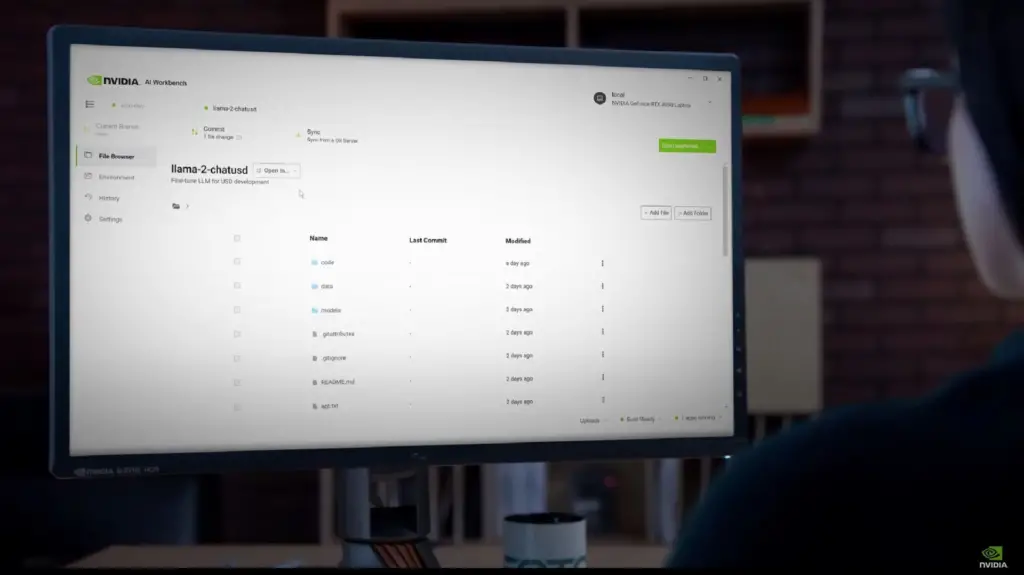

En se connectant à des référentiels populaires tels que HuggingFace, GitHub, le portail web d’entreprise de Nvidia appelé NVIDIA NGC et diverses sources de code d’IA open source ou commercial, Nvidia AI Workbench offre un espace centralisé pour les développeurs.

Ils peuvent accéder à ces ressources sans avoir à naviguer dans plusieurs fenêtres de navigateur, ce qui simplifie le processus d’importation et de personnalisation du code du modèle en fonction de leurs préférences et de leurs besoins.

Dans une annonce récente, la société a souligné que le Nvidia AI Workbench pourrait révolutionner la façon dont les développeurs interagissent avec les centaines de milliers de modèles d’IA pré-entraînés qui existent. Traditionnellement, la personnalisation de ces modèles a été une tâche compliquée, mais Nvidia AI Workbench est conçu pour simplifier considérablement le processus.

Avec ce nouvel outil, les développeurs peuvent facilement modifier et exécuter l’IA générative, en accédant à tous les modèles essentiels de qualité professionnelle. La prise en charge s’étend à divers frameworks, bibliothèques et SDK de la plateforme d’IA de Nvidia, ainsi qu’à d’importants référentiels open source tels que GitHub et Hugging Face.

Nvidia AI Workbench ne se limite pas à la personnalisation ; il facilite également le partage entre plusieurs plateformes. Les développeurs qui utilisent une carte graphique Nvidia RTX dans leur PC ou leur station de travail peuvent gérer ces modèles génératifs localement. Si nécessaire, l’évolutivité vers les ressources des centres de données et l’informatique en nuage devient une transition fluide.

« Nvidia AI Workbench offre un chemin simplifié aux équipes inter-organisationnelles pour créer des applications basées sur l’IA qui deviennent de plus en plus essentielles dans les entreprises modernes », a déclaré Manuvir Das, vice-président de l’informatique d’entreprise chez Nvidia.

La version 4.0 de Nvidia AI Enterprise a également été publiée

Parallèlement à Nvidia AI Workbench, le géant technologique a lancé la quatrième version de sa plateforme logicielle Nvidia AI Enterprise, spécialement conçue pour fournir des outils essentiels à l’adoption et à la personnalisation de l’IA générative dans un environnement d’entreprise.

Nvidia AI Enterprise 4.0 vise à faciliter l’intégration transparente et sécurisée des modèles d’IA générative dans diverses opérations, soutenue par des connexions API stables.

La plateforme nouvellement lancée comprend une variété d’outils, y compris Nvidia NeMo pour le support cloud-native et le support complet pour les applications de modèles de langage à grande échelle (LLM), et Nvidia Triton Management Service pour automatiser et améliorer les déploiements de production.

En outre, Nvidia Base Command Manager Essentials, un logiciel de gestion de clusters, a été intégré pour aider les entreprises à optimiser les performances dans les centres de données, les environnements multicloud et hybrides.

L’annonce a également mis en lumière des collaborations avec des géants de l’industrie tels que ServiceNow, Snowflake et Dell Technologies, ouvrant la voie à une large gamme de nouveaux produits d’IA, démontrant une fois de plus l’engagement de Nvidia à mener l’innovation dans le domaine de l’IA.

L’entrée de Nvidia sur le marché de l’IA semble être bien synchronisée, offrant non seulement Workbench, mais aussi d’autres outils tels que Nvidia ACE pour les applications de jeu. Les modèles d’IA générative tels que ChatGPT devenant de plus en plus populaires, de nombreux développeurs seront probablement attirés par les solutions complètes et conviviales de Nvidia.

Toutefois, cette accessibilité s’accompagne également d’un certain degré d’incertitude, car l’utilisation de l’IA générative peut parfois conduire à des applications douteuses. Les implications générales des innovations de Nvidia dans ce domaine ne sont pas encore totalement comprises.