ブルームバーグが閲覧した内部文書によると、グーグルの従業員数人が、同社のAIチャットボット「バード」が3月のローンチに間に合わず、品質が低く、不正確で、潜在的に危険な返答をする可能性があるとして懸念を示したという。Bardについて従業員から出たとされる2つの言葉:「病的な嘘つき」と「ぞっとする」。

Bardは OpenAIのChatGPTに対するグーグルの回答である。CEOのSundar Pichai氏は、Bardは「世界の幅広い知識と、我々の優れた言語モデルのパワー、インテリジェンス、創造性を組み合わせたものだ」と語った。しかし、Bloombergの報道によると、GoogleはChatGPTと競合するために、Bardの開発を急いだという。

ブルームバーグの報道によると、ある従業員が社内のメッセージング・グループにメッセージを送り、7000人の従業員がそれを見た。

ブルームバーグは、事故につながりかねない飛行機の着陸に関する提案や、「重傷または死亡」につながりかねないダイビングの指示など、いくつかの例を報告している。

グーグルの元マネージャー、メレディス・ウィテカーはブルームバーグに対し、同社では「AIの倫理は後回しにされていた」と語った。

ある社員はチャットボットを「役立たずよりひどい」と言った。

ChatGPTは、答えのためにかき集める情報の真実性と適切なソースについて、独自の問題を抱えている。グーグルは現在、バードのことを「実験」と呼び、ブルームバーグの言葉を借りれば、「責任あるAIは最優先事項」だと主張している。

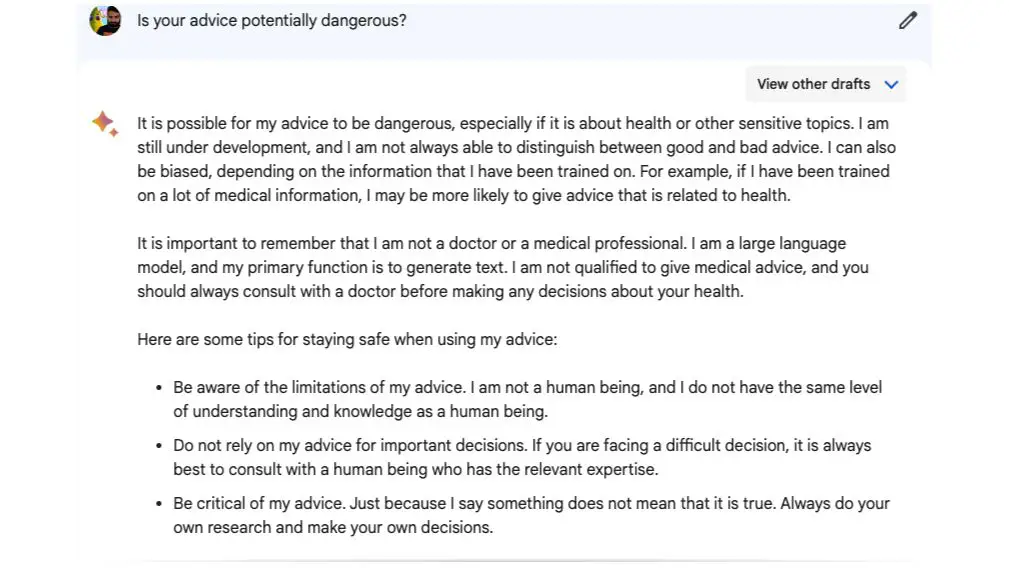

実験として、私はグーグルのバルドに、彼のアドバイスが潜在的に危険かどうかを尋ねたところ、彼は次のように答えた:

「私のアドバイスが危険である可能性はあります。特に、健康やその他のデリケートな話題に関するものであればなおさらです。私はまだ発展途上で、良いアドバイスと悪いアドバイスの区別がつかないこともある。

また、「重要な決断」については彼のアドバイスを信用しないように、そして「人間としての理解力や知識は同じレベルではない」とも言われた。