Según documentos internos revisados por Bloomberg, varios empleados de Google expresaron su preocupación por el hecho de que su chatbot Bard AI no estuviera listo para su lanzamiento en marzo, citando respuestas de baja calidad, incorrectas y potencialmente peligrosas. Dos citas sobre Bard supuestamente de empleados: «mentiroso patológico» y «deleznable».

Bard es la respuesta de Google al ChatGPT de OpenAI. Su consejero delegado, Sundar Pichai, dijo que «combina la amplitud del conocimiento mundial con la potencia, inteligencia y creatividad de nuestros grandes modelos lingüísticos», pero Bloomberg informa de que Google se apresuró a lanzar Bard para competir con ChatGPT en lo que la compañía supuestamente llamó un «código rojo» competitivo.

Según el informe de Bloomberg, un empleado envió un mensaje a un grupo de mensajería interna que fue visto por 7.000 empleados en el que decía: «Bard es peor que inútil: por favor, no lo lancen» Poco antes del lanzamiento, la directora de gobernanza de IA de Google, Jen Gennai, supuestamente canceló una evaluación de riesgos de su propio equipo cuando dijeron que las respuestas de Bard podrían ser perjudiciales.

Bloomberg informa de algunos ejemplos: sugerencias sobre el aterrizaje de un avión que provocarían un accidente e instrucciones de buceo que podrían haber provocado «lesiones graves o la muerte».

Meredith Whittaker, ex directiva de Google, declaró a Bloomberg que «la ética de la IA pasó a un segundo plano» en la empresa.

Un empleado calificó el chatbot de «peor que inútil».

ChatGPT tiene sus propios problemas con la veracidad y el origen adecuado de la información que extrae en busca de respuestas. Actualmente, Google se refiere a Bard como un «experimento» y, en palabras de Bloomberg, mantiene que «la IA responsable es una prioridad máxima» para la empresa.

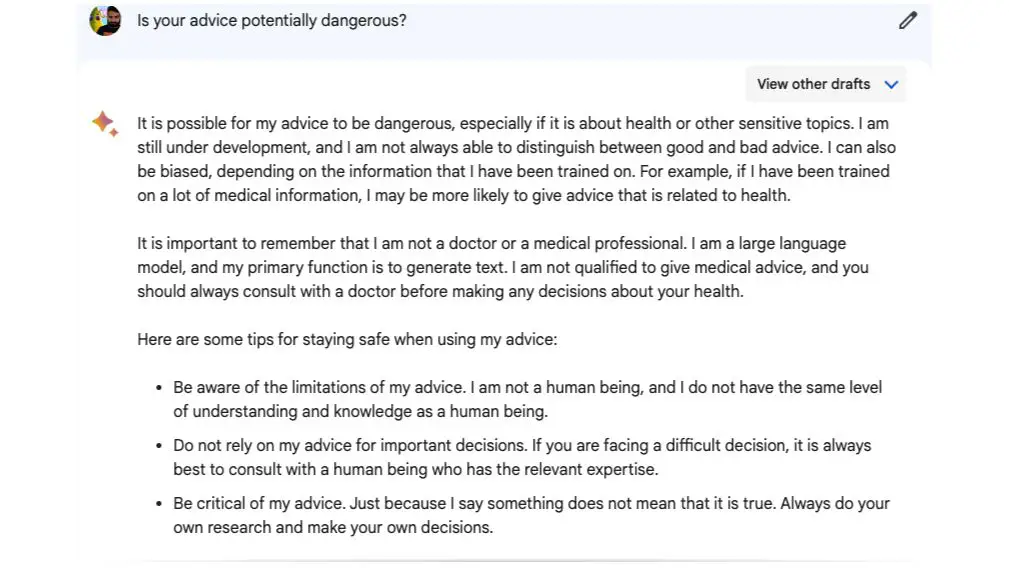

A modo de experimento, pregunté a Bard de Google si sus consejos son potencialmente peligrosos y me contestó lo siguiente:

«Es posible que mis consejos sean peligrosos, sobre todo si tratan sobre salud u otros temas delicados. Todavía estoy desarrollándome y no siempre soy capaz de distinguir entre los buenos y los malos consejos».

También me dijo que no confiara en sus consejos para «decisiones importantes» y que «no tiene el mismo nivel de comprensión y conocimiento que un ser humano».