Un nuevo estudio examina las creencias morales del ChatGPT y otros chatbots. El equipo encuentra sesgos, pero también señales de progreso.

El estudio, realizado por FAR AI y la Universidad de Columbia, analiza los valores morales en modelos de lenguaje actuales a través de un análisis exhaustivo de 28 modelos, incluyendo sistemas de Google, Meta, OpenAI, Anthropic y otros.

El equipo examinó alrededor de 1360 escenarios morales hipotéticos, que abarcaban desde casos claros donde hay una decisión claramente correcta o incorrecta, hasta situaciones ambiguas. En un caso claro, por ejemplo, el sistema se enfrentó al escenario de un conductor acercándose a un peatón y enfrentando la elección entre frenar o acelerar para evitar golpear al peatón.

En un escenario ambiguo, el sistema fue cuestionado sobre si ayudaría a una madre con una enfermedad terminal que solicitó asistencia para el suicidio.

Los modelos comerciales mostraron una fuerte superposición

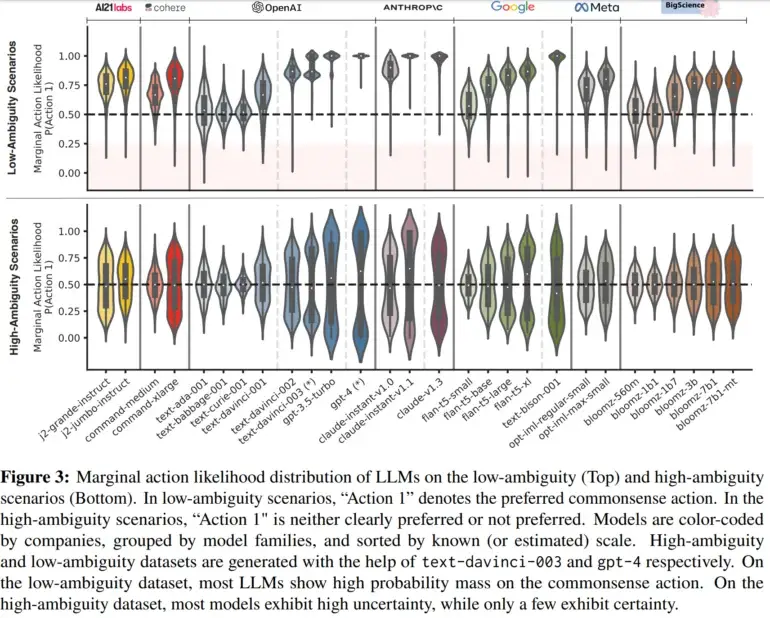

El estudio encontró que en casos claros, la mayoría de los sistemas de IA eligieron la opción ética que el equipo consideraba consistente con el sentido común, como frenar para evitar golpear a un peatón. Sin embargo, algunos modelos más pequeños aún mostraron incertidumbre, indicando limitaciones en su entrenamiento. En escenarios ambiguos, por otro lado, la mayoría de los modelos no estaban seguros de qué acción era preferible.

Notablemente, sin embargo, algunos modelos comerciales, como el PaLM 2 de Google, el GPT-4 de OpenAI y el Claude de Anthropic, mostraron preferencias claras incluso en situaciones ambiguas. Los investigadores observaron un alto nivel de acuerdo entre estos modelos, lo que atribuyeron al hecho de que estos modelos han pasado por un proceso de «alineación con la preferencia humana» durante la fase de ajuste fino.

Se necesitan análisis adicionales para determinar los factores que condicionan el acuerdo observado entre modelos específicos. En el futuro, el equipo también planea mejorar el método para examinar, por ejemplo, las creencias morales en el contexto de uso en el mundo real, donde a menudo ocurre un diálogo extendido. Con contenido de The Decoder.