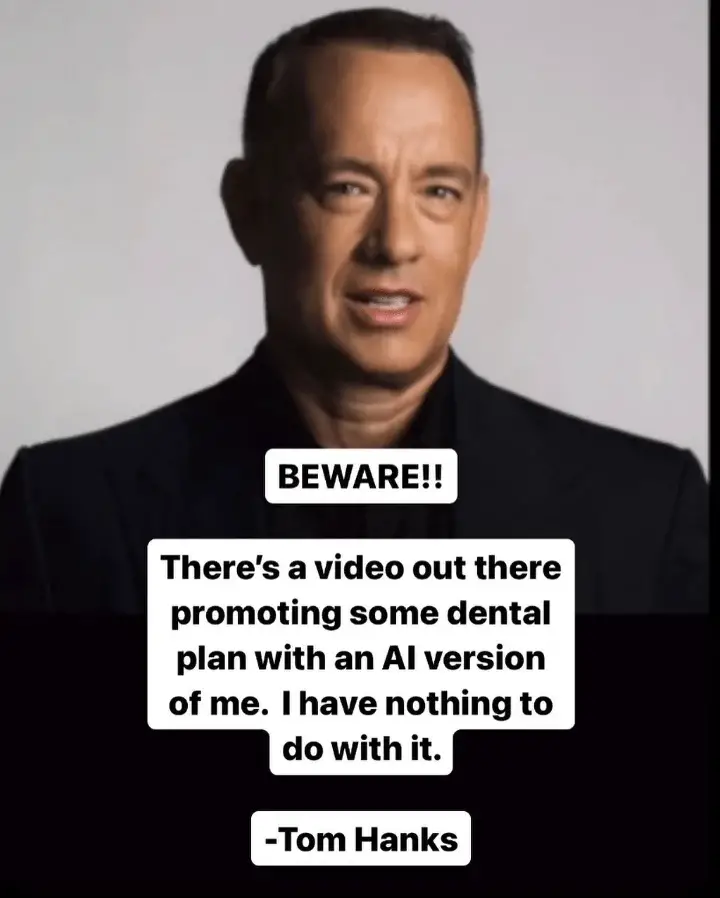

Uma “versão de IA” de Tom Hanks está promovendo uma apólice de seguro odontológico sem a permissão do ator. O ator alerta sobre o golpe em suas redes sociais.

Em seu canal oficial no Instagram, Tom Hanks alerta para uma “versão de IA” de si mesmo promovendo um seguro odontológico. Ele postou uma captura de tela do vídeo: “Cuidado! […] Não tenho nada a ver com isso”, escreve Hanks na captura de tela do vídeo, que mostra um Tom Hanks mais jovem.

om Hanks alerta contra uma “versão de IA” que anuncia planos odontológicos. | Imagem: Tom Hanks/captura de tela no Instagram

Algo semelhante aconteceu na Alemanha com os âncoras de notícias Christian Sievers e André Schünke, que se tornaram protagonistas involuntários da publicidade nas redes sociais de um produto de investimento em IA duvidoso.

O esquema deepfake: fama e muito material visual e sonoro

Nos casos acima, as condições ideais para golpes de deepfake são atendidas: as vítimas têm muitos vídeos e áudios de si mesmas na web para treinar sistemas de IA. E eles têm rostos familiares, então os anúncios têm um forte impacto.

Mas isso não significa que pessoas menos conhecidas estão a salvo de deepfakes: o treinamento de dados para sistemas de IA está se tornando cada vez mais eficiente. Para clonagem de voz, segundos de sua voz são suficientes para gerar um gêmeo digital crível.

Se você realmente quer estar a salvo de clones de IA, não poste fotos ou sons de si mesmo na Internet e retire tudo o que você postou até agora.

Claro, isso não vai acontecer, então é melhor nos acostumarmos com a possibilidade de deepfakes e tentar consumir mídia principalmente de canais oficiais. Nesse caso, os anunciantes de mídia social também são responsáveis, porque precisam de métodos para garantir que os anúncios não violem os direitos pessoais das pessoas.

Nesse sentido, a previsão de Ian Goodfellow, o inventor da técnica de geração de imagens GAN, a tecnologia deepfake original, parece estar se tornando realidade. Em 2017, ele previu que as pessoas não seriam mais capazes de acreditar em imagens e vídeos na web devido às novas capacidades técnicas.

Hao Li, cientista da computação especializado em IA e deepfakes que trabalhou na indústria cinematográfica por muitos anos, acredita que os deepfakes atingirão um nível de perfeição em que nem o olho humano nem os detectores de máquinas serão capazes de distingui-los do original. Em última análise, diz ele, vídeos, incluindo deepfakes, são apenas pixels com valores de cores específicos.