Une « version IA » de Tom Hanks fait la promotion d’une police d’assurance dentaire sans l’autorisation de l’acteur. L’acteur met en garde contre l’arnaque sur ses réseaux sociaux.

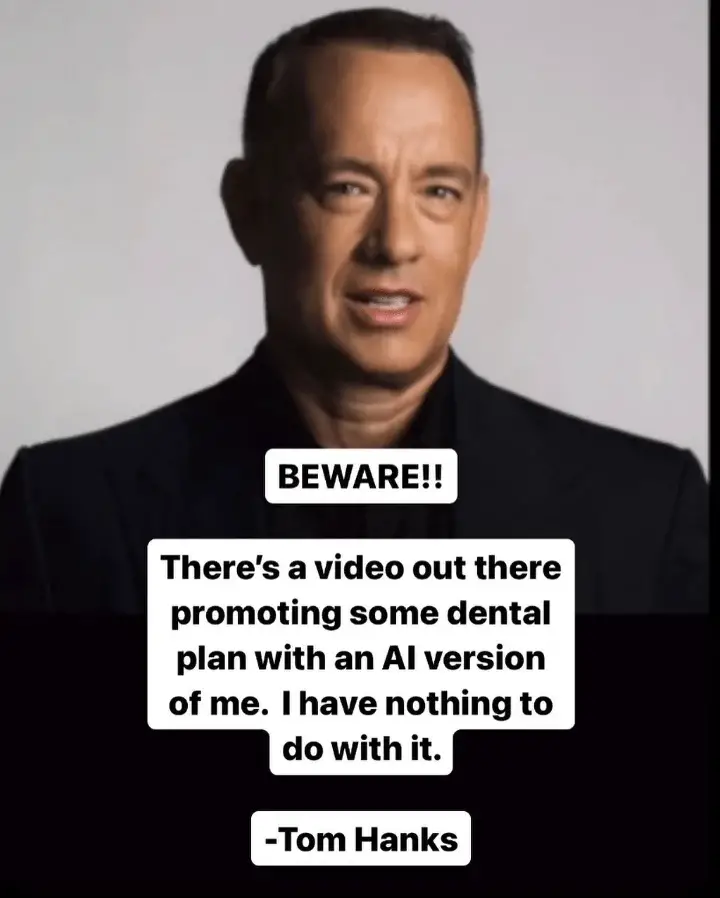

Sur sa chaîne officielle Instagram, Tom Hanks met en garde contre une « version IA » de lui-même faisant la promotion d’une assurance dentaire. Il a posté une capture d’écran de la vidéo : « Attention ! […] Je n’ai rien à voir avec ça », écrit Tom Hanks dans la capture d’écran de la vidéo, qui montre un Tom Hanks plus jeune.

tom Hanks met en garde contre une « version IA » qui fait de la publicité pour des soins dentaires | Image : Tom Hanks/capture d’écran sur Instagram

Un phénomène similaire s’est produit en Allemagne avec les présentateurs de journaux télévisés Christian Sievers et André Schünke, qui sont devenus les protagonistes involontaires d’une publicité sur les médias sociaux pour un produit d’investissement douteux basé sur l’IA.

L’escroquerie deepfake : la célébrité et beaucoup de matériel visuel et audio

Dans les cas susmentionnés, les conditions idéales pour les deepfake scams sont réunies : les victimes disposent d’un grand nombre de vidéos et d’enregistrements audio d’elles-mêmes sur le web pour entraîner les systèmes d’IA. De plus, elles ont des visages familiers, de sorte que les publicités ont un fort impact.

Mais cela ne signifie pas que les personnes moins connues sont à l’abri des deepfakes : l’entraînement des données pour les systèmes d’IA devient de plus en plus efficace. Pour le clonage vocal, quelques secondes de votre voix suffisent pour générer un jumeau numérique crédible.

Si vous voulez vraiment être à l’abri des clones d’IA, ne publiez pas de photos ou de sons de vous sur l’internet et supprimez tout ce que vous avez publié jusqu’à présent.

Bien sûr, cela n’arrivera pas, alors nous ferions mieux de nous habituer à la possibilité des deepfakes et d’essayer de consommer les médias principalement à partir des canaux officiels. Dans ce cas, les annonceurs des médias sociaux sont également responsables, car ils ont besoin de méthodes pour s’assurer que les publicités ne violent pas les droits personnels des gens.

En ce sens, la prédiction de Ian Goodfellow, l’inventeur de la technique d’imagerie GAN, la technologie originale de deepfake, semble se réaliser. En 2017, il a prédit que les gens ne seraient plus en mesure de croire les images et les vidéos sur le web en raison des nouvelles capacités techniques.

Hao Li, informaticien spécialisé dans l’IA et les deepfakes qui a travaillé dans l’industrie cinématographique pendant de nombreuses années, estime que les deepfakes atteindront un niveau de perfection tel que ni l’œil humain ni les détecteurs de machines ne pourront les distinguer de l’original. En fin de compte, dit-il, les vidéos, y compris les deepfakes, ne sont que des pixels avec des valeurs de couleur spécifiques.