A Tesla deve lançar seu aguardado supercomputador na segunda-feira, de acordo com @SawyerMerritt. A máquina será usada para várias aplicações de inteligência artificial (IA), mas o cluster é tão poderoso que também pode ser usado para cargas de trabalho exigentes de computação de alto desempenho (HPC). Na verdade, o supercomputador baseado no Nvidia H100 será uma das máquinas mais poderosas do mundo.

O novo cluster da Tesla empregará 10.000 GPUs de computação Nvidia H100, que oferecerão um desempenho máximo de 340 FP64 PFLOPS para computação técnica e 39,58 INT8 ExaFLOPS para aplicações de IA. Na verdade, os 340 FP64 PFLOPS da Tesla são superiores aos 304 FP64 PFLOPS oferecidos pelo Leonardo, o quarto supercomputador de melhor desempenho do mundo.

(Imagem: @SawyerMerritt/Twitter)

Com seu novo supercomputador, a Tesla está aprimorando significativamente suas capacidades de computação para treinar sua tecnologia de direção autônoma completa (FSD) mais rápido do que nunca. Isso pode não apenas tornar a Tesla mais competitiva do que outras montadoras, mas tornará a empresa dona de um dos supercomputadores mais rápidos do mundo.

“Devido ao treinamento em vídeo do mundo real, podemos ter os maiores conjuntos de dados de treinamento do mundo, capacidade de cache de camada quente além de 200PB – ordens de grandeza mais do que LLMs”, explicou Tim Zaman, gerente de engenharia de plataforma de IA da Tesla.

(Imagem: @SawyerMerritt/Twitter)

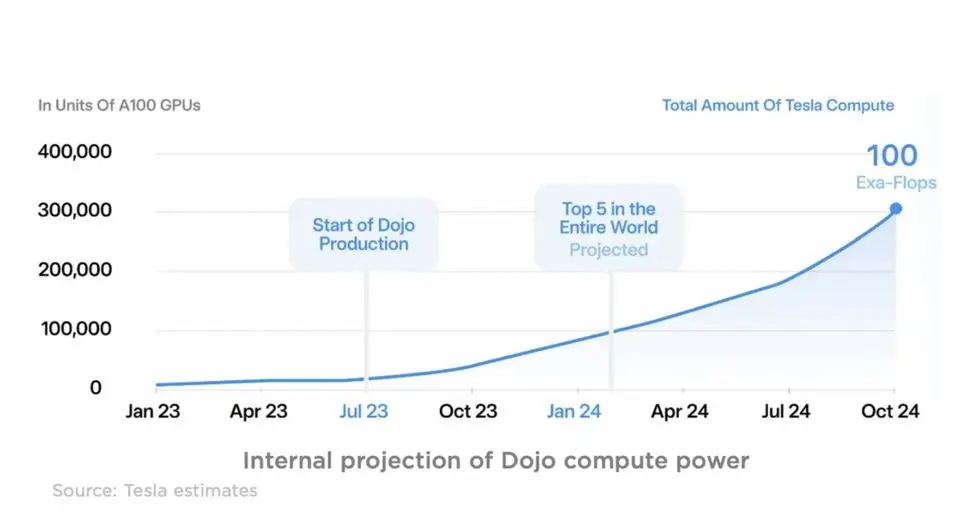

Enquanto o novo cluster baseado em H100 deve melhorar drasticamente a velocidade de treinamento da Tesla, a Nvidia está lutando para atender à demanda por essas GPUs. Como resultado, a Tesla está investindo mais de US$ 1 bilhão para desenvolver seu próprio supercomputador, o Dojo, que é construído com base em chips personalizados e altamente otimizados.

O Dojo não apenas acelerará o treinamento FSD, mas também gerenciará o processamento de dados para toda a frota de veículos da Tesla. A Tesla está simultaneamente trazendo seu cluster de GPU Nvidia H100 online junto com o Dojo, um movimento que dará à empresa um poder de computação incomparável na indústria automotiva.

Elon Musk revelou recentemente que a Tesla planeja gastar mais de US$ 2 bilhões em treinamento de IA em 2023 e outros US$ 2 bilhões em 2024 especificamente em computação para treinamento de FSD. Isso ressalta o compromisso da Tesla em superar gargalos computacionais e deve fornecer vantagens substanciais sobre seus rivais.