Agente ALE da Sakana AI atinge a 21ª posição entre 1.000 especialistas em código

A empresa japonesa Sakana AI desenvolveu um agente de inteligência artificial capaz de resolver problemas complexos de otimização utilizados na indústria. Em uma competição ao vivo, sua IA enfrentou mais de 1.000 programadores humanos.

O agente ALE da Sakana AI alcançou a 21ª posição no 47º Concurso Heurístico AtCoder, demonstrando que os sistemas de IA podem competir com especialistas humanos em desafios de programação de alta exigência. O AtCoder realiza competições de programação no Japão, onde os participantes solucionam problemas matemáticos complexos por meio de código. Esses problemas, caracterizados como NP-difíceis, não possuem soluções eficientes conhecidas, o que os torna especialmente desafiadores.

As tarefas propostas refletem desafios reais da indústria, como o planejamento de rotas de entrega, a organização de turnos de trabalho, o gerenciamento da produção industrial e o balanceamento de redes elétricas. Normalmente, os concorrentes humanos dedicam semanas para aperfeiçoar suas soluções.

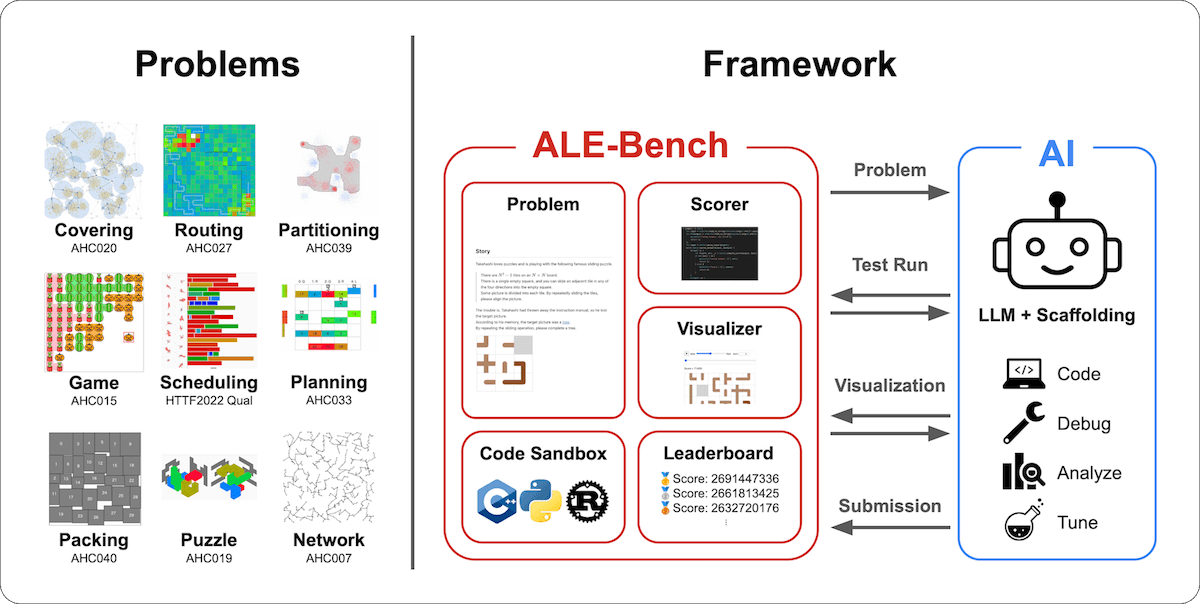

Esse trabalho tem como base o ALE‑Bench, considerado pela Sakana AI como o primeiro benchmark para programação algorítmica baseada em pontuação. O benchmark engloba 40 problemas de otimização complexos oriundos de concursos anteriores do AtCoder. Diferentemente de testes tradicionais, que apenas indicam se uma resposta está correta ou não, o ALE‑Bench exige aprimoramentos contínuos ao longo do tempo.

Agente de IA combina conhecimento especializado e busca inteligente

O agente ALE opera com o Gemini 2.5 Pro do Google e incorpora duas estratégias principais. A primeira consiste em integrar conhecimento especializado sobre métodos de solução comprovados diretamente em suas instruções. Entre essas técnicas está o recozimento simulado, que testa mudanças aleatórias nas soluções e, ocasionalmente, aceita resultados piores para escapar de mínimos locais.

O recozimento simulado foi fundamental para o aumento dos resultados de desempenho do agente ALE.

Em segundo lugar, o sistema utiliza um algoritmo de busca sistemática, o “best‑first search”, que sempre seleciona a solução parcial mais promissora para desenvolvê-la ainda mais. O agente aprimora essa abordagem por meio de uma estratégia semelhante à “beam search”, explorando simultaneamente 30 caminhos diferentes de solução. Ainda, usa um mecanismo de “taboo search” que registra as soluções já testadas, evitando repetições.

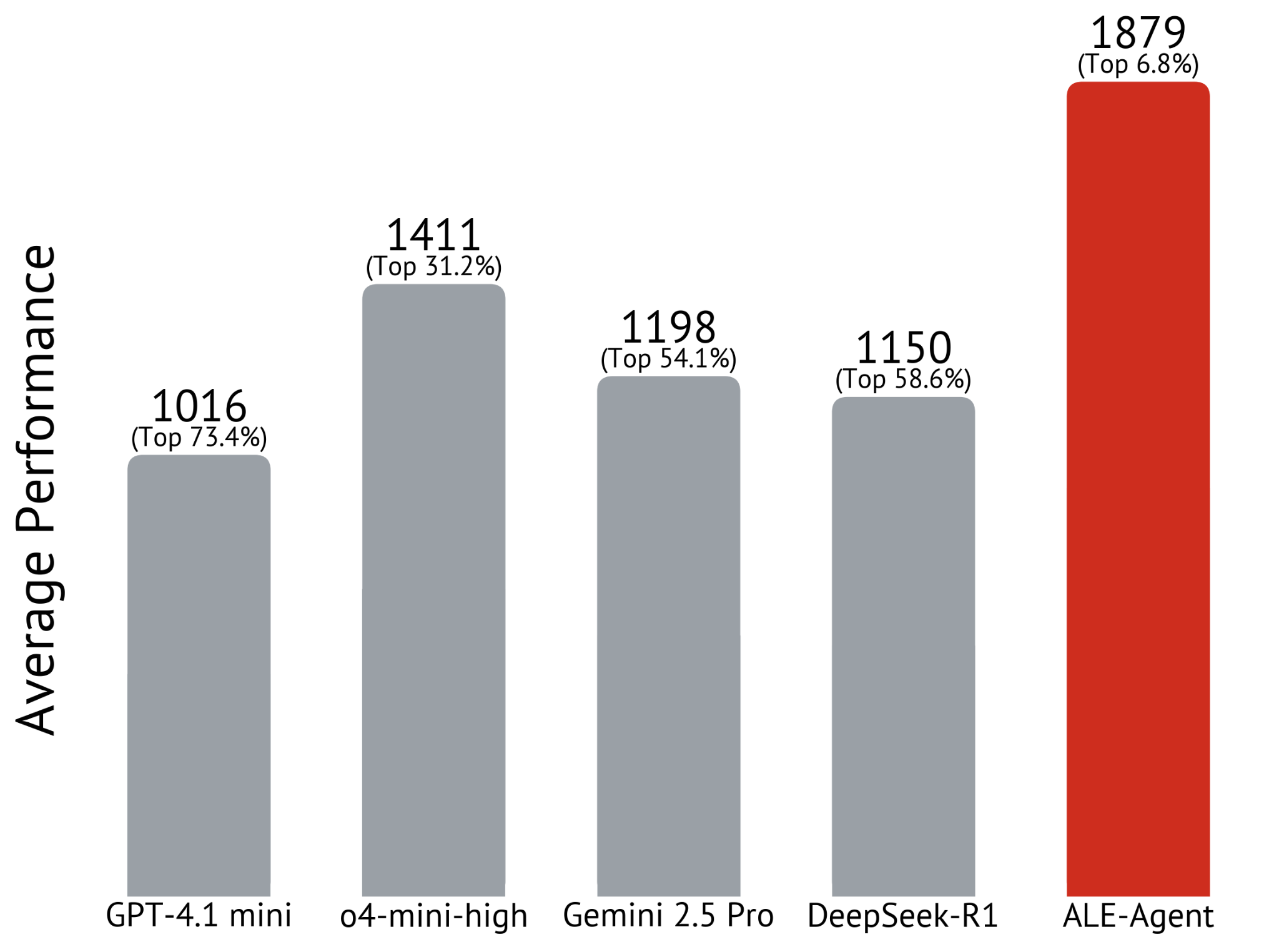

Durante os testes, o melhor modelo (o4‑mini‑high) atingiu 1.411 pontos com aperfeiçoamentos sequenciais. Sob condições idênticas, o GPT‑4.1 mini marcou 1.016 pontos, o Deepseek‑R1 chegou a 1.150 pontos e o Gemini 2.5 Pro obteve 1.198 pontos.

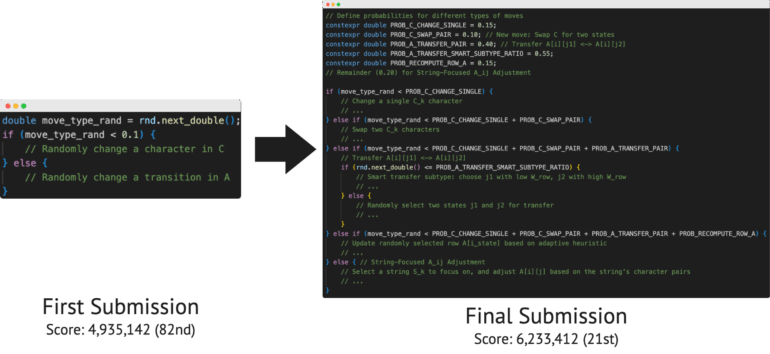

O agente ALE completo superou esses resultados, alcançando 1.879 pontos e posicionando-se no top 6,8%. Em um problema específico, a IA obteve 2.880 pontos, o que garantiu a 5ª colocação na competição original.

Com os 1.879 pontos, o agente ALE domina claramente o ranking do ALE‑Bench.

Uma importante diferença entre a abordagem da IA e dos concorrentes humanos reside justamente na quantidade de soluções testadas. Enquanto os competidores humanos podem experimentar uma dúzia de soluções em uma competição de quatro horas, a IA da Sakana é capaz de executar cerca de 100 versões no mesmo período, chegando a gerar centenas ou milhares de soluções potenciais – um feito impossível para os humanos.

A Sakana AI disponibilizou o ALE‑Bench como uma biblioteca Python, incluindo uma “sandbox” de código para testes seguros. Essa estrutura funciona com C++, Python e Rust, operando sobre a infraestrutura de nuvem padrão da Amazon. O benchmark foi desenvolvido em parceria com a AtCoder Inc. Os dados dos 40 problemas de competição estão disponíveis no Hugging Face e o código pode ser acessado no GitHub.