Empresa israelense Lightricks torna código aberto seu modelo LTX-2 com 19 bilhões de parâmetros

A Lightricks, empresa israelense, colocou à disposição o código fonte de seu modelo LTX-2, que conta com 19 bilhões de parâmetros. O sistema gera conteúdo audiovisual sincronizado a partir de descrições textuais e afirma ser mais rápido que os concorrentes.

De acordo com o relatório técnico, o modelo produz até 20 segundos de vídeo com áudio estéreo sincronizado a partir de um único prompt de texto. Isso inclui fala com sincronização labial, sons de fundo, efeitos Foley e músicas adequadas a cada cena. A versão completa do LTX-2 atinge resolução 4K a até 50 quadros por segundo, conforme informado pela Lightricks.

Os pesquisadores afirmam que as abordagens atuais para a geração audiovisual são fundamentalmente falhas. Muitos sistemas operam de forma sequencial – primeiro gerando o vídeo e, em seguida, adicionando o áudio, ou vice-versa. Essas cadeias desconectadas não conseguem captar a real distribuição conjunta entre as duas modalidades. Enquanto a sincronização labial depende predominantemente do áudio, o ambiente acústico é influenciado pelo contexto visual. Apenas um modelo unificado pode lidar com essas dependências bidirecionais.

Por que a arquitetura assimétrica é importante para a geração audiovisual

O LTX-2 opera com um transformer dual-stream assimétrico, totalizando 19 bilhões de parâmetros. O fluxo de vídeo possui 14 bilhões de parâmetros – capacidade significativamente maior do que os 5 bilhões destinados ao fluxo de áudio. Segundo os pesquisadores, essa divisão reflete a diferente densidade de informações de cada modalidade.

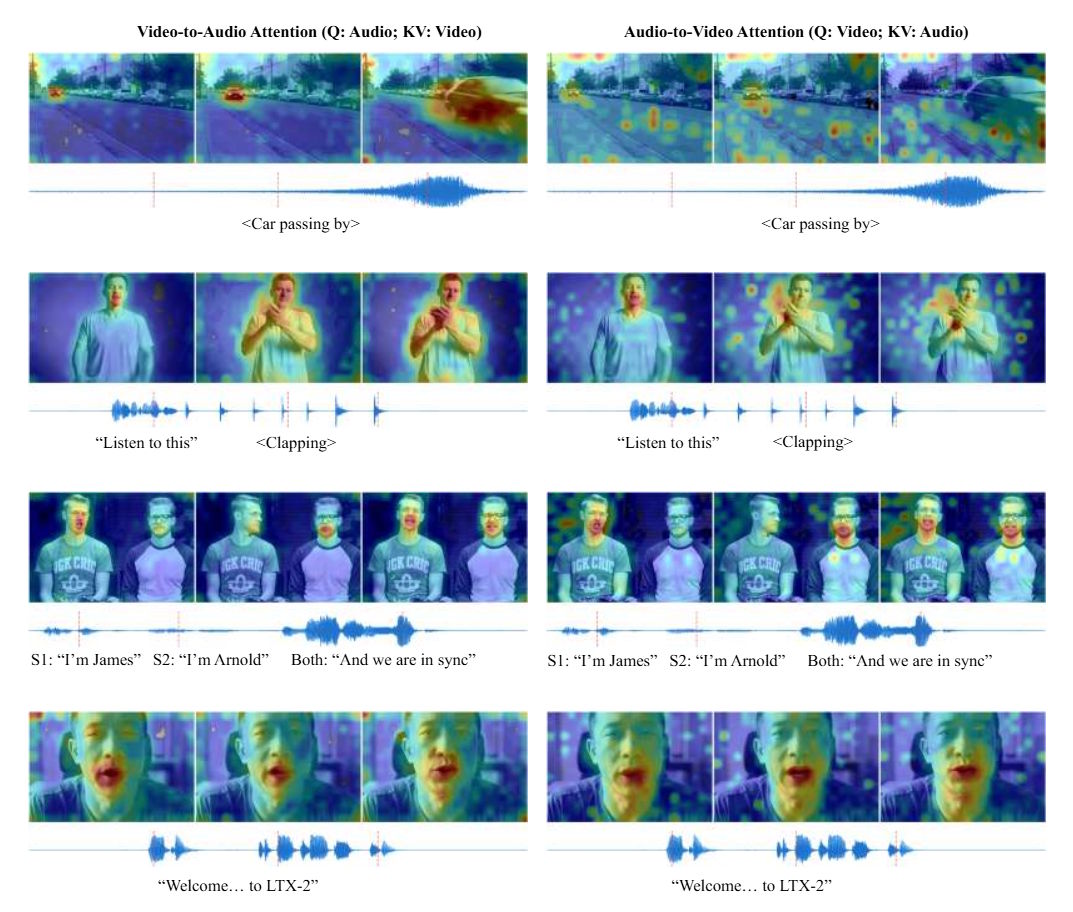

Ambos os fluxos utilizam autoencoders variacionais independentes para suas respectivas modalidades. Essa separação possibilita o uso de codificações posicionais específicas: embeddings rotacionais tridimensionais (RoPE) para capturar a estrutura espaço-temporal do vídeo e embeddings unidimensionais para o aspecto puramente temporal do áudio. Camadas de cross-attention bidirecionais conectam os dois fluxos, vinculando com precisão eventos visuais – como um objeto batendo no chão – aos sons correspondentes.

Os mapas de cross-attention demonstram como o LTX-2 relaciona os elementos visuais e sonoros.

Para a compreensão dos textos, o LTX-2 utiliza o Gemma3-12B como codificador multilíngue. Em vez de consultar apenas a última camada do modelo de linguagem, o sistema aproveita todas as camadas decodificadoras e combina suas informações. O modelo também emprega os “thinking tokens” – marcadores adicionais na sequência de entrada que ampliam a capacidade de processar prompts complexos antes do início da geração.

Ganho de velocidade coloca o LTX-2 à frente dos concorrentes

Benchmarks apontam que o LTX-2 possui vantagens significativas em termos de velocidade de inferência. Em uma GPU Nvidia H100, o modelo necessita de 1,22 segundos por etapa para processar 121 quadros em resolução 720p. Em comparação, o Wan2.2-14B – que gera apenas vídeo, sem áudio – demanda 22,30 segundos. Assim, o LTX-2 é 18 vezes mais rápido, conforme a Lightricks.

A duração máxima de 20 segundos também supera a concorrência: o Veo 3 do Google alcança 12 segundos, o Sora 2 da OpenAI atinge 16 segundos e o modelo open-source Ovi, da Character.AI, chega a 10 segundos. Em estudos de preferência humana, o LTX-2 “supera significativamente” alternativas open-source como o Ovi e apresenta resultados comparáveis a modelos proprietários como o Veo 3 e o Sora 2.

Entretanto, os pesquisadores reconhecem algumas limitações. A qualidade pode variar conforme o idioma – a síntese de fala tende a ser menos precisa para idiomas ou dialetos menos representados. Em cenas com múltiplos falantes, o modelo ocasionalmente associa o conteúdo falado aos personagens equivocados. Sequências que ultrapassam os 20 segundos podem apresentar deriva temporal e sincronização comprometida.

Lançamento open-source desafia a abordagem de API fechada

A Lightricks justificou a decisão de tornar o modelo open-source como uma crítica ao mercado atual. “Eu simplesmente não vejo como você pode alcançar isso apenas com APIs fechadas”, afirma Zeev Farbman, fundador da empresa, em vídeo de anúncio acerca das promessas dos modelos atuais de geração de vídeo. Segundo ele, a indústria se encontra em um impasse: por um lado, é possível criar resultados impressionantes, mas, por outro, o nível de controle desejado pelos profissionais ainda está distante.

A empresa também adota uma postura explicitamente ética. “A inteligência artificial pode ampliar a criatividade e a inteligência humanas. O que me preocupa é que outra pessoa passe a ter controle sobre essa amplificação”, continuou Farbman. O objetivo é viabilizar a execução da IA em hardware próprio, definindo os próprios termos e tomando decisões éticas em conjunto com uma ampla comunidade de criadores, ao invés de terceirizá-las para um grupo restrito com interesses individuais.

Além dos pesos do modelo, o lançamento inclui uma versão destilada, diversos adaptadores LoRA e um framework de treinamento modular com suporte multi-GPU. O modelo é otimizado para o ecossistema RTX da Nvidia e pode ser executado tanto em GPUs de consumo, como a RTX 5090, quanto em sistemas empresariais. Os pesos e o código do modelo estão disponíveis no GitHub e no Hugging Face, e há uma demonstração na plataforma de conteúdo da empresa após registro gratuito.