現在、すべてのAI画像モデルは拡散モデルを使用しています。OpenAI は、より高速で、DALL-E 3 のような新しいモデルにも適用可能な代替案を提示しています。

DALL-E 2、Stable Diffusion、Midjourneyは、画像生成中にノイズから徐々に画像を合成する拡散モデルを使用しています。同じ反復プロセスが、オーディオやビデオのモデルにも使われています。

拡散モデルは素晴らしい結果を出し、テキストプロンプトで制御できるが、比較的遅く、GANの10倍から2000倍の計算能力を必要とする。そのため、リアルタイムのアプリケーションで使用するのは難しい。

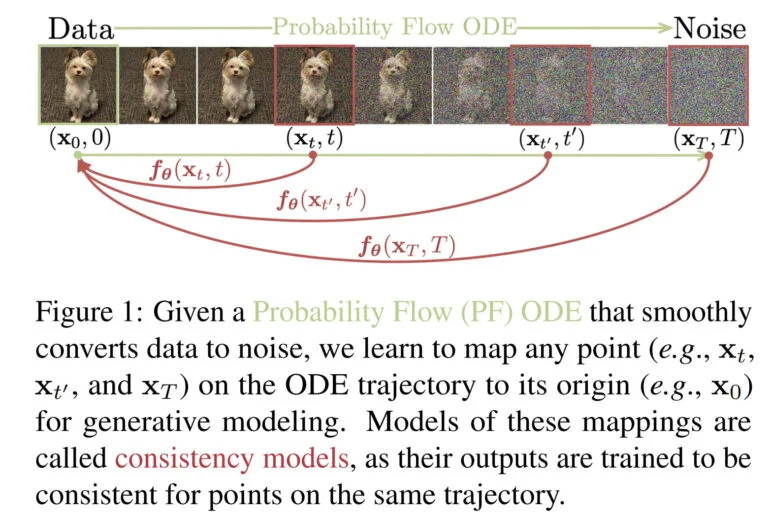

そこでOpenAIは、「一貫性モデル」と呼ばれる生成AIモデルの新しいバリエーションを開発している。

一貫性モデルは、拡散モデルとGANの利点を組み合わせるように設計されている。

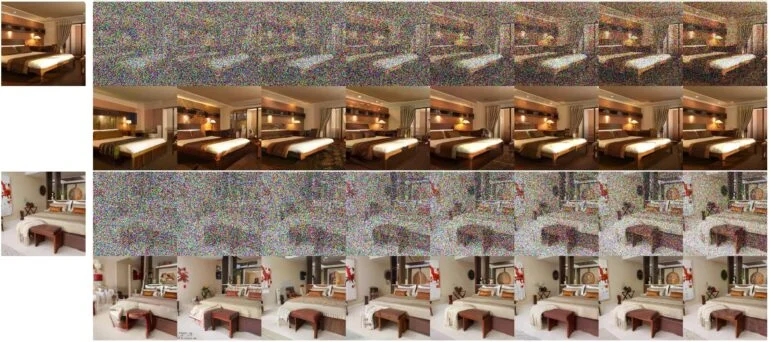

OpenAIによると、一貫性モデルは、1ステップで画像の迅速な合成をサポートするだけでなく、「サンプルの品質と計算をトレードオフする」ために、数ステップでサンプリングすることもできる。

したがって、一貫性モデルは、反復プロセスなしでも有用な結果を生成することができ、近い将来、リアルタイムのアプリケーションに適するようになるかもしれない。

拡散モデルと同様に、ペイント、カラー化、超解像タスクなど、ゼロショットでのデータ編集もサポートする。

一貫性モデルは、事前に訓練された拡散モデルから抽出することも、独自に訓練することもできる。OpenAIによると、一貫性モデルは、シングルステップ生成において多くのGANや他のすべての非逆行シングルステップ生成モデルを凌駕することができます。

同社は、例えば猫の画像を合成するニューラルネットワークを訓練するなど、比較的小規模なネットワークと画像データセットですべてのテストを実施した。すべてのモデルは、研究目的でオープンソースとして公開されている。

DALL-E 3と映像合成のための新しい生成AIアーキテクチャ?

著者らによると、強化学習による深層Q学習や半教師付き学習によるモーメントベースの対比学習など、他分野で使用されている他のAI技術とも顕著な類似点があるという。「このことは、これらの多様な分野間でアイデアや手法を掛け合わせるエキサイティングな展望をもたらす」と研究チームは言う。

DALL-E 2が発表されるまでの数ヶ月間、OpenAIは拡散モデルに関する論文をいくつか発表し、最終的に当時非常に印象的だったモデルであるGLIDEを発表した。

したがって、一貫性モデルの研究は、オープンAIが、例えば、リアルタイム映像生成に使用するために、より高速なDALL-E 3を可能にする、より効果的な新しいAI生成アーキテクチャを探していることの表れかもしれない。

したがって、OpenAIの現在の研究は、より大規模なAIモデルが次のステップである可能性が高い、フィージビリティスタディとみなされるべきです。同じアーキテクチャは、いずれ他のモダリティや3Dコンテンツ合成にも使用できるだろう。