Le cadre « Tree of Thoughts » combine la recherche arborescente avec GPT-4 pour améliorer considérablement les capacités de résolution de problèmes du modèle de langage.

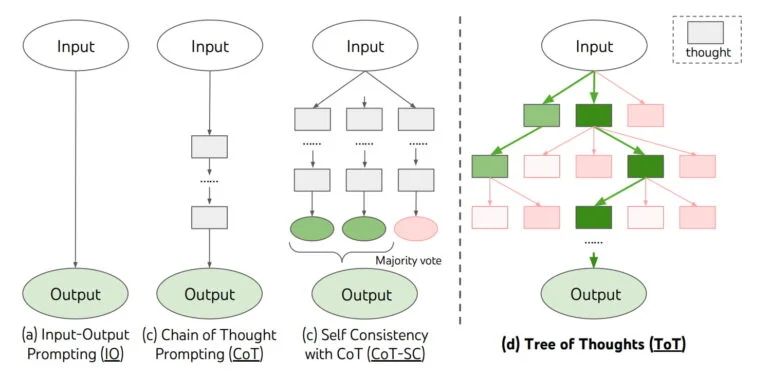

« Tree of Thoughts » est un nouveau cadre développé par des chercheurs de l’université de Princeton et de Google DeepMind pour déduire des modèles de langage tels que GPT-4, inspiré par des méthodes d’ingénierie des messages-guides telles que la chaîne de pensée (Chain of Thought). Cependant, contrairement à ces méthodes, ToT n’est pas basé uniquement sur des invites, mais utilise un module externe pour utiliser des unités de texte, que l’équipe appelle « pensées », comme étapes intermédiaires pour résoudre des problèmes.

Selon l’équipe, ToT permet à GPT-4 de prendre des décisions « en considérant plusieurs voies de raisonnement différentes et en évaluant ses choix pour décider de la ligne de conduite suivante, ainsi qu’en regardant vers l’avant ou vers l’arrière lorsque c’est nécessaire pour prendre des décisions globales ».

Dans les expériences, l’équipe démontre que le cadre de la ToT améliore considérablement la capacité de GPT-4 à résoudre des problèmes, parfois de manière spectaculaire. Par exemple, alors que le GPT-4 n’est capable de résoudre que 4 % des tâches du « Jeu des 24 » avec la stratégie d’incitation de la chaîne de pensée, le modèle de langage avec la ToT atteint un taux de réussite de 74 %. La ToT améliore également de manière significative les performances du GPT-4 dans les mots croisés et les tâches d’écriture créative.

GPT-4 et AlphaZero s’unissent

ToT améliore ainsi les capacités de raisonnement rudimentaires des grands modèles de langage tels que GPT-4 grâce à des heuristiques de recherche similaires à celles utilisées dans les systèmes d’IA tels qu’AlphaZero. Contrairement au système d’IA de DeepMind, ToT n’apprend pas, mais met en œuvre les heuristiques de recherche par le biais de l’auto-évaluation et de la délibération de GPT-4. Selon l’équipe, ToT s’inspire également de la distinction établie par Daniel Kahneman entre le système 1 et le système 2.

Le cadre de l’arbre des pensées permet de traduire les connaissances classiques en matière de résolution de problèmes en méthodes applicables aux modèles linguistiques contemporains. En même temps, les modèles linguistiques répondent à une faiblesse de ces méthodes classiques en fournissant un moyen de résoudre des problèmes complexes qui ne sont pas facilement formalisables, comme l’écriture créative.

Yao et al.

Dans un autre article préliminaire, un chercheur de Theta Labs présente également une méthode appelée « Tree of Thoughts » et des améliorations significatives dans les puzzles de Sudoku. L’auteur cite les techniques de jeu automatique bien connues d’AlphaZero comme une piste de recherche intéressante. Une méthode similaire pourrait permettre au système de FdF de développer des stratégies innovantes de résolution de problèmes qui ne sont pas présentes dans le corpus de textes d’entraînement des modèles de langage.