Environ 100 000 identifiants d’utilisateurs de ChatGPT auraient été divulgués sur le darknet. OpenAI a publié une déclaration à ce sujet.

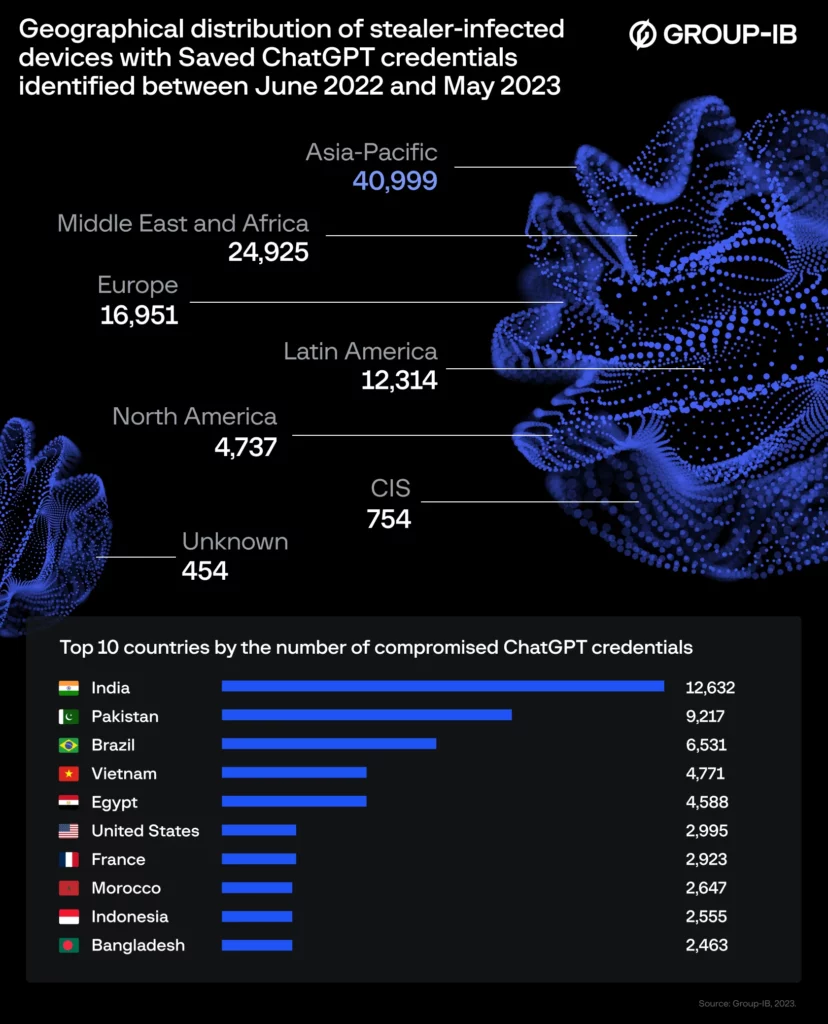

La plupart des utilisateurs concernés sont originaires des États-Unis, de France, du Maroc, d’Indonésie, du Pakistan et du Brésil. Les données les plus anciennes remonteraient à juin 2022. ChatGPT a été rendu public en novembre 2022.

Deux jours après les premiers rapports sur l’incident du darknet, OpenAI a fait une déclaration à Tom’s Hardware. La société insiste sur le fait que ni elle ni ses utilisateurs n’ont été visés et que les comptes qui ont fuité font l’objet d’une enquête.

Obtenir des comptes ChatGPT n’a jamais été aussi facile

Selon les analystes en sécurité de Group-IB, la plupart des informations d’identification compromises ont été trouvées dans des journaux associés à divers logiciels malveillants. En tête de liste, le logiciel Raccoon, censé être facile à utiliser, est responsable de 78 348 comptes compromis.

Les résultats du rapport de renseignement sur les menaces du Group-IB sont « le résultat de logiciels malveillants courants sur les appareils des utilisateurs et non d’une violation de l’OpenAI », a déclaré un porte-parole de l’OpenAI.

Il a ajouté qu’OpenAI suit les meilleures pratiques de l’industrie pour l’authentification et l’autorisation des utilisateurs, et encourage les utilisateurs à utiliser des mots de passe forts et à n’installer que des logiciels vérifiés et de confiance sur leurs ordinateurs.

ChatGPT est une cible sensible

Il n’est pas rare que des données sensibles tombent entre de mauvaises mains lors de fuites de comptes. Dans le cas de ChatGPT, cependant, l’impact peut être particulièrement dramatique : étant donné que ChatGPT stocke tous les chats par défaut, les attaquants pourraient, par inadvertance, accéder à un « trésor d’informations sensibles » avec les données divulguées. Les gens utilisent ChatGPT pour discuter de toutes sortes de sujets, y compris d’informations personnelles ou professionnelles sensibles.

Samsung, par exemple, a interdit l’utilisation de ChatGPT par crainte d’une violation de données après une affaire dans laquelle des employés de l’entreprise ont saisi des codes confidentiels. Les employés qui utilisent encore ChatGPT chez Samsung pourraient être licenciés. Apple a également interdit l’utilisation de ChatGPT.

En réponse à la pression politique, OpenAI a mis en place, fin avril, une fonction d’exclusion volontaire qui supprime automatiquement tous les chats et les retire des supports de formation. Pour plus de 100 000 comptes ayant fait l’objet d’une fuite, cette mesure arrive trop tard : selon des chercheurs en sécurité, les données fuitées sont depuis longtemps en vente sur le darknet. Il n’y a pas de mal à changer de mot de passe.