OpenAI domine les médias avec ChatGPT, mais l’entreprise mène également des recherches sur d’autres modèles d’IA générative. Un nouvel article présente un modèle de texte vers 3D.

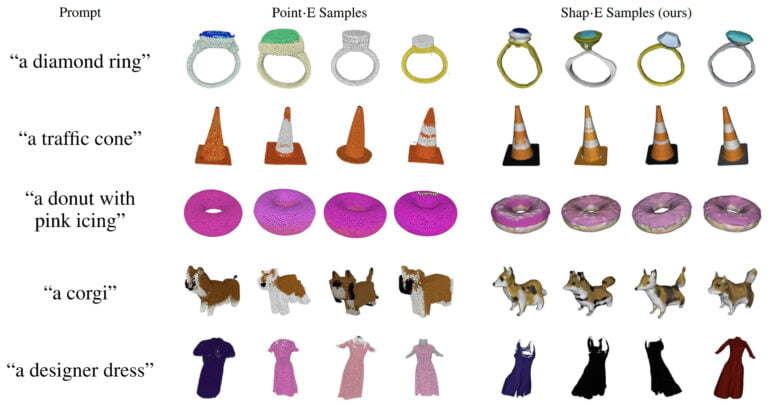

Fin 2022, OpenAI a lancé Point-E, un modèle d’IA générative pour texte vers 3D qui a reçu peu d’attention en raison du succès énorme de ChatGPT le même mois. En partie, cela s’explique par le fait que Point-E n’a pas produit de résultats particulièrement impressionnants.

Avec Point-E, OpenAI a tenté de fournir un modèle de texte vers 3D particulièrement rapide basé sur des nuages de points. Près de six mois plus tard, les chercheurs de l’entreprise présentent maintenant Shap-E, un successeur direct.

Shap-E est extrêmement rapide et légèrement meilleur Contrairement à Point-E, Shap-E ne génère pas de nuage de points, mais des paramètres de fonctions implicites qui peuvent être rendus sous forme de maillages texturés et de NeRFs. Essentiellement, un encodeur convertit l’entrée de texte ou d’image en ces fonctions, et un modèle de diffusion génère la représentation 3D souhaitée.

Tout comme son prédécesseur, la qualité de ces rendus est parfois bien inférieure à celle d’alternatives telles que Dreamfusion, Dreamfields, Magic3D, Dream3D ou CLIP-Mesh. Cependant, alors que CLIP-Mesh nécessite 17 minutes, Dreamfusion nécessite 12 heures et Dreamfields peut nécessiter jusqu’à 200 heures pour un modèle sur un GPU Nvidia v100, Shap-E a seulement besoin de 13 secondes avec une entrée de texte et seulement une minute avec une entrée d’image.

Le Shap-E peut être combiné avec le DreamFusion

OpenAI indique que les résultats « mettent en lumière le potentiel de générer des représentations implicites, notamment dans des domaines tels que la 3D, où elles peuvent offrir plus de flexibilité que les représentations explicites ».

Cependant, le Shap-E présente également de nombreuses limites, telles que l’attribution de multiples attributs à un objet ou la représentation du nombre correct d’objets. L’équipe attribue ces lacunes à des données d’entraînement limitées et estime qu’elles pourraient être réduites en collectant et en générant des ensembles de données 3D plus importants et étiquetés. De plus, la qualité des objets est limitée.

Cependant, pour obtenir de meilleurs résultats, le Shap-E peut être combiné avec d’autres techniques de génération 3D basées sur l’optimisation. Par exemple, l’équipe montre qu’un modèle Shap-E peut être affiné comme un NeRF avec DreamFusion.

Si OpenAI trouve une architecture appropriée, elle devrait être mise à l’échelle. Si le Shap-E sera utilisé à cette fin reste à voir, mais des projets tels qu’Objaverse créent de vastes bases de données de données 3D étiquetées.

Le code et le modèle sont disponibles sur GitHub.