Como usar o GPT-4 de Graça

Vamos descobrir como obter o ChatGPT 4 sem pagar? Ou o GPT-4 será gratuito? GPT-4 é um modelo de linguagem “multimodal” recentemente lançado pela OpenAI.

Vamos descobrir como obter o ChatGPT 4 sem pagar? Ou o GPT-4 será gratuito? GPT-4 é um modelo de linguagem “multimodal” recentemente lançado pela OpenAI.

Midjourney e DALL-E demonstraram que a inteligência artificial pode produzir obras visuais impressionantes. Na verdade, o impacto da IA na arte é tão significativo que

A OpenAI anuncia parcerias com Le Monde e Prisa Media para integrar conteúdo de notícias ao ChatGPT. O que acontece com os editores que não

Uma empresa Saudita de robótica revelou um robô humanoide “masculino”, mas o lançamento não saiu como planejado. O robô, chamado “Muhammad, o Robô Humanóide“, foi

Modelos de linguagem de grande escala (LLMs), agindo como agentes diplomáticos em cenários simulados, mostraram “escaladas difíceis de prever que frequentemente terminavam em ataques nucleares.

Uma start-up chamada Perplexity mostra o que é possível para um mecanismo de busca construído do zero com inteligência artificial. Pela minha vida adulta inteira,

O Google está experimentando com grandes modelos de linguagem para ajudar os usuários a descobrirem mais lugares no Google Maps. O Google está incorporando inteligência

A partir de hoje, você pode gerar imagens no Bard em grande parte dos países e usar o Gemini Pro em qualquer idioma, país e

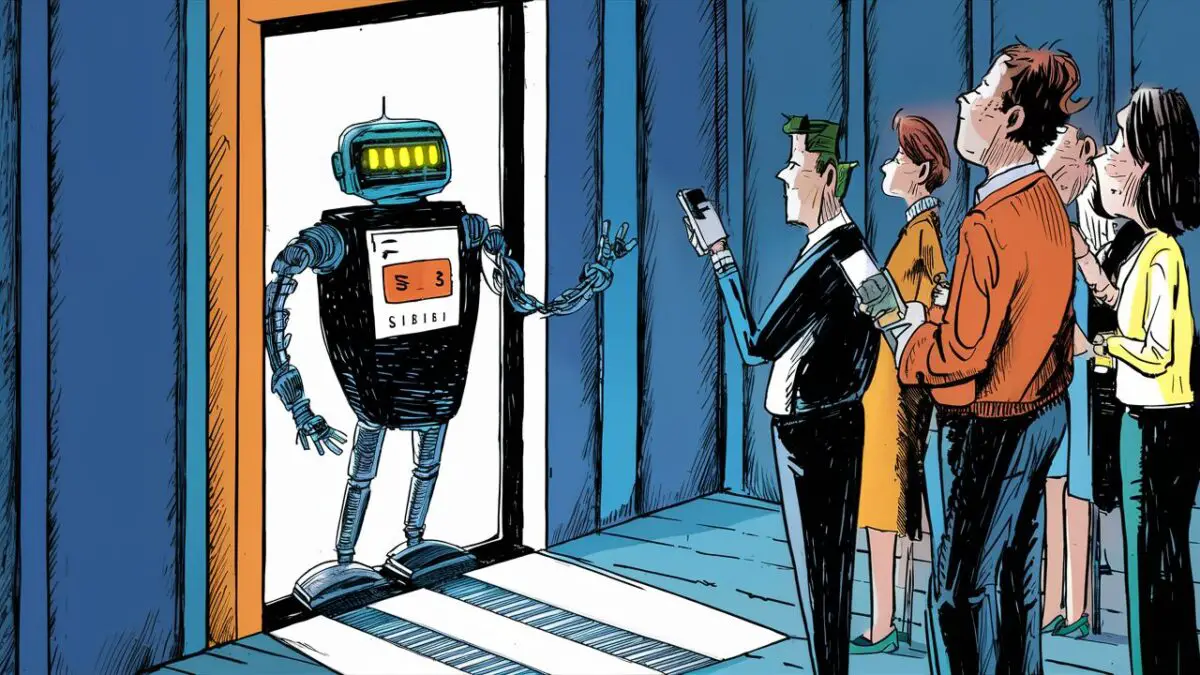

Pouco mais de um ano após o lançamento público do ChatGPT, estamos começando a ver uma previsão se concretizar sobre como ele poderia afetar a

A inteligência artificial (IA) ressuscitou línguas antigas que eram faladas no passado, mas que sobreviveram apenas em forma escrita. Através de vídeos, a IA tornou