Dados recentemente divulgados pela fornecedora chinesa de IA Deepseek revelam que os modelos de linguagem podem, em teoria, gerar margens de lucro substanciais — mesmo sendo comercializados a preços significativamente inferiores aos da OpenAI.

A Deepseek ofereceu uma visão rara dos custos operacionais e do potencial de lucratividade de seus serviços de IA. Os números indicam que a empresa poderia alcançar uma margem de lucro teórica de 545% se monetizasse totalmente seus serviços, mesmo mantendo sua estratégia de código aberto e cobrando menos que concorrentes como a OpenAI.

Gerenciamento inteligente de recursos mantém os custos baixos

Durante um período de teste de 24 horas, os modelos da Deepseek processaram 608 bilhões de tokens de entrada e 168 bilhões de tokens de saída. A empresa atendeu mais da metade das entradas (56,3%) por meio de um sistema de cache, reduzindo significativamente os custos.

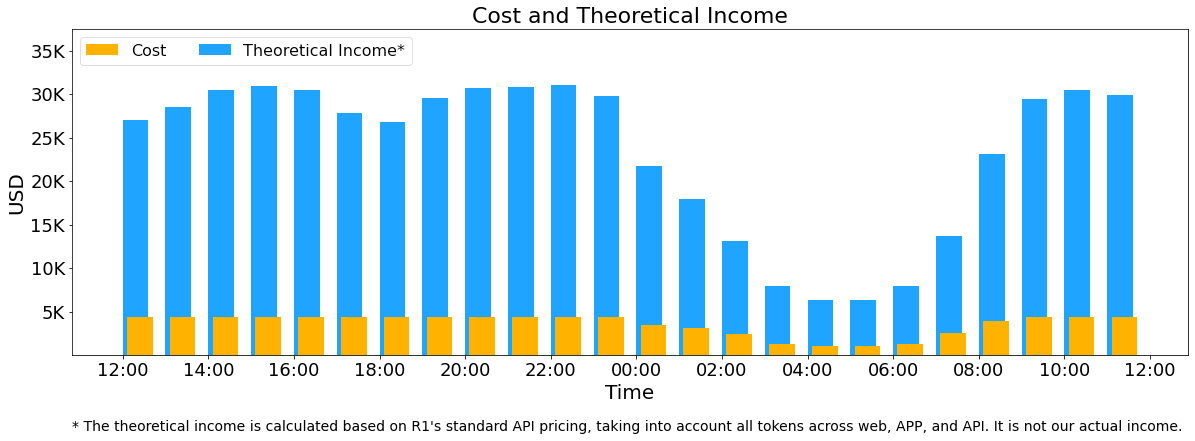

Para maximizar a eficiência, a Deepseek utiliza um sistema dinâmico de alocação de recursos. Durante o dia, todos os nós processam as requisições de inferência; à noite, com a queda da demanda, os recursos são redirecionados para tarefas de pesquisa e treinamento.

A infraestrutura de hardware para essa operação custa US$ 87.072 por dia, utilizando em média 226,75 nós de servidores. Cada nó contém oito GPUs Nvidia H800, considerando um custo estimado de US$ 2 por GPU por hora.

Um único nó H800 processa cerca de 73.700 tokens de entrada por segundo durante o pré-carregamento ou 14.800 tokens de saída durante a decodificação, com uma velocidade média de saída de 20 a 22 tokens por segundo.

Os dados financeiros do Deepseek demonstram que a receita teórica máxima poderia superar os custos operacionais em até seis vezes, utilizando a precificação ideal do modelo R1. Se a empresa cobrasse o valor integral por cada token processado com as taxas do modelo premium R1 — US$ 0,14 por milhão de tokens de entrada para acertos de cache, US$ 0,55 para erros de cache e US$ 2,19 por milhão de tokens de saída — a receita diária alcançaria US$ 562.027. No entanto, as receitas reais ainda estão bem abaixo desses números teóricos, já que a maior parte dos serviços é oferecida gratuitamente e os descontos noturnos são aplicados, com somente o acesso à API gerando receita.

A comoditização dos serviços de IA

A transparência incomum do Deepseek reflete uma dinâmica do setor: embora os modelos de linguagem possam, teoricamente, gerar margens de lucro substanciais, capturar esse valor se mostra desafiador. Entre a concorrência acirrada, as estruturas de preços escalonadas e a necessidade de oferecer serviços gratuitos, os lucros efetivos tendem a diminuir significativamente.

Nesse contexto, a recente estratégia de preços da OpenAI se destaca. O modelo GPT-4.5, por exemplo, é comercializado a preços premium bem acima dos de seus predecessores e de concorrentes como o Deepseek, mesmo oferecendo apenas melhorias modestas em desempenho.

Os dados do Deepseek sugerem que os modelos de linguagem estão se transformando em serviços commoditizados, onde o preço premium já não reflete vantagens reais de desempenho. Essa realidade cria uma pressão adicional sobre empresas ocidentais de IA, como a OpenAI, que enfrentam elevados custos operacionais e perdas bilionárias, enquanto as forças do mercado impulsionam a redução dos preços.

Esse cenário pode ser uma das razões pelas quais o gerente de GTM da OpenAI, Adam Goldberg, enfatizou recentemente que o sucesso na área de IA depende do controle de toda a cadeia de valor — desde a infraestrutura e os dados até os modelos e as aplicações. À medida que os modelos de linguagem se tornam commoditizados, a vantagem competitiva passa a residir não apenas nos próprios modelos, mas na capacidade de integrar e otimizar toda a pilha tecnológica.