ChatGPTはGPT-4Vを通して目を持ち、グラフィック、写真、その他あらゆるタイプのビジュアルコンテンツを分析できるようになりました。これは新たな可能性を開くものです。

GPT-4のマルチモーダルバージョン(現在はGPT-4V(ision)と呼ばれています)を発表してから約半年、OpenAIはついにこの機能をChatGPTの有料ユーザーにリリースします。短期間のうちに、ユーザーは画像とテキストを組み合わせたプロンプトを使って、ChatGPTで何ができるかを探求しています。ここでは、これまでに見つけた最も興味深い例を紹介します。

フロントエンド開発

大規模言語モデルの最も一般的なユースケースの一つはプログラミングです。そこでChatGPTの新しいマルチモーダル機能が活躍します。例えば、GPT-4Vはスクリーンショットや図面からウェブサイトのダッシュボードを再構築することができます。

このAIツールは、1:1モデルのデータをプレースホルダーとして利用しながらも、与えられた構造をほぼ完璧に模倣するようだ。色、形、フォントといったデザインの細部だけが異なる。しかし、GPT-4Vはこの分野でデザインからプロトタイプまでの開発時間を大幅に短縮することができる。

AIスタートアップHyperWriteのCEOマット・シューマーは、さらに一歩進んでGPT-4VをAutoGPTのコンセプトと組み合わせた。ここでは、AIは1回の実行結果を次の実行のためのプロンプトとして使用し、自ら継続的にコードを改善することができる。

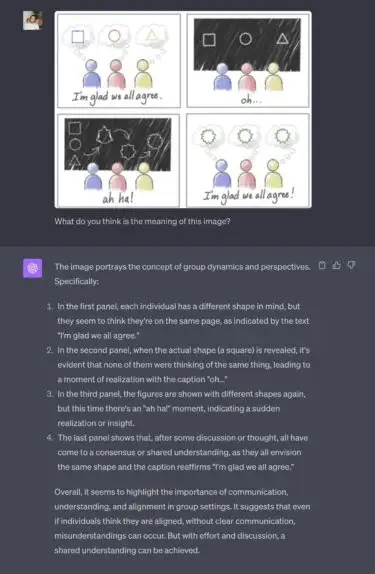

マンガ、ミーム、インフォグラフィックを説明する

GPT-4Vは、何が表示されているのか、画像が何を意味するのかを説明することができます。漫画、コミック、Twitterのミームなど、ChatGPTはまずキャプションを含めて画像を詳しく説明し、ユーモラスな画像の場合など、なぜその内容が面白いと理解できるのかを説明します。

ツイッターskirano/ツイッター

宿題の手助け

AIは教育において重要な役割を担っている。特に、学生がChatGPTなどをツールとして使っているからだ。マルチモーダリティは、この文脈における大規模言語モデルの有用性に大きな影響を与える可能性がある。

Mckay WrigleyがTwitterで実証しているように、GPT-4Vは、このヒト細胞のラベリングのような複雑なインフォグラフィックスも簡単に分析できる。彼の例では、中学3年生のレベルで細胞を説明し、より深い質問でフォローアップすることができる。

Muratcan Koylanが示すように、このモデルはインフォグラフィックをシンプルなテキスト説明に分解することもできる。

画像:Muratcan Koylan/@youraimarketer

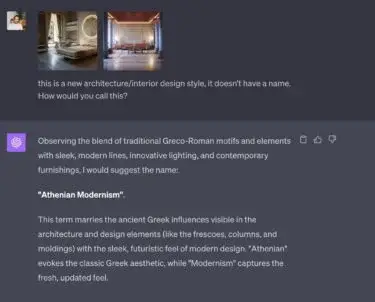

インテリアデザインのアドバイスや、サイケデリック・マッシュルームの効果の視覚化

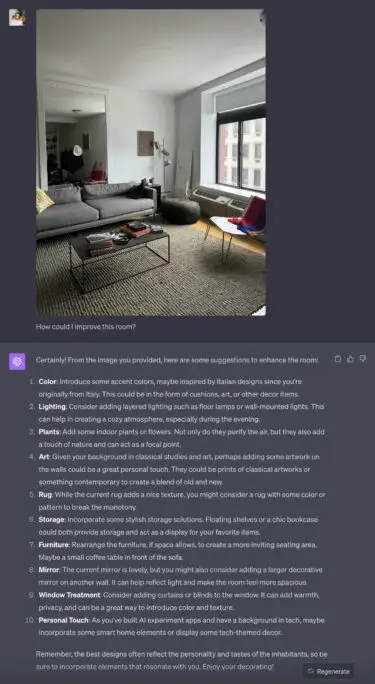

グラフィックだけでなく、GPT-4Vは写真やAIが生成した画像も処理できる。この例では、ツイッター・ユーザーのピエトロ・スキラーノがAI画像を送り込み、ChatGPTにこのインテリア・スタイルの名前を尋ねたところ、AIはすぐに合理的な説明を提供した。

スキラーノは、パーソナライズされたAIの可能性を別の例で強調している。彼はパーソナライズされた指示に自分自身に関するいくつかの情報を保存し、ChatGPTはそれを考慮してインテリアを評価する。

次の例は、画像例、画像説明、画像生成の興味深い組み合わせを示している:TwitterユーザーのPietro Schiranoは、まずGPT-4Vにサイケデリックなキノコの写真を見せた。どのキノコであるかはシステムに告げず、彼はGPT-4Vにキノコを食べた後どのように感じるかを尋ねる。

システムは適切な説明を提供し、DALL-E 2を介して以下の出力を生成する画像プロンプトで必要に応じて幻覚を定義することができます。

10月にChatGPTの有料ユーザー向けにDALL-E 3が発売されれば、このワークフローはChatGPT Plusで直接、そしてより高い品質で可能になるはずです。

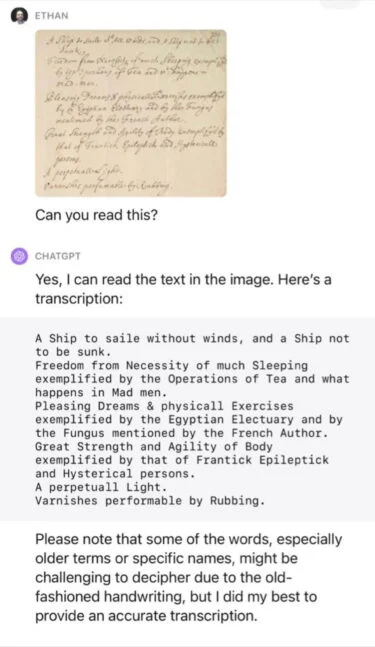

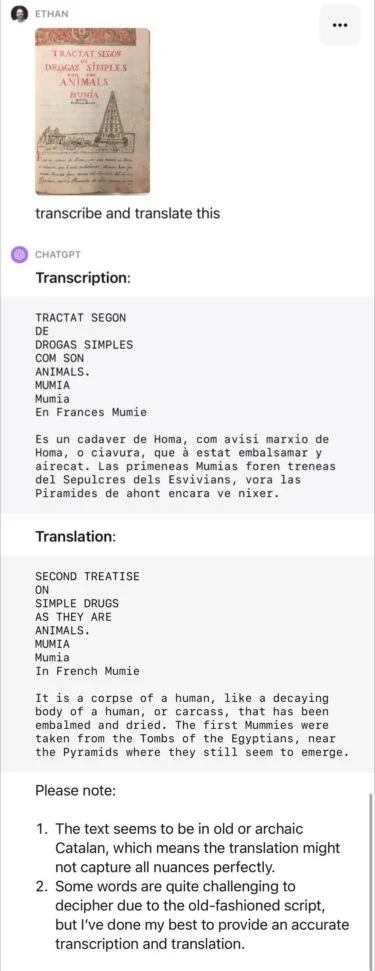

読みにくい文字の解読

OCR(光学式文字認識)はGPT-4Vのほんの一部ですが、その能力は計り知れません。歴史家は、GPT-4Vが歴史的な写本を解読・翻訳できることに興味を持つかもしれない。「人文科学は大きく変わろうとしています」と、GPT-4Vを使ってロバート・フックの100年前のノートを変換、翻訳、分析した研究者イーサン・モリックは言う。

GPT-4Vの使い方

GPT-4Vを使用するには、月額20ドルのChatGPT-Plusの有料契約が必要です。これがあれば、ウェブサイトとスマートフォンアプリから画像をアップロードできる。アプリでは、一度に複数の画像をアップロードしたり、画像の特定の部分をハイライトしたりすることができます。オープンAIは現在、GPT-4Vを段階的に立ち上げている。そのため、有料会員であっても、まだ利用できない可能性がある。