O Google habilita geração nativa de imagens em seu modelo Gemini 2.0 Flash

O Google habilitou recursos nativos de geração de imagens em seu modelo de linguagem Gemini 2.0 Flash para desenvolvedores. De acordo com uma publicação no blog da empresa, essa funcionalidade já pode ser testada por meio do Google AI Studio e da API Gemini em todas as regiões suportadas. O processo de integração exige pouco código, e uma versão experimental do Gemini 2.0 Flash foi disponibilizada para testes.

Processamento multimodal incorporado melhora a precisão

O diferencial da geração de imagens do Gemini está em sua base multimodal. O Modelo Multimodal de Grande Porte (LML) combina compreensão de texto, raciocínio aprimorado e processamento de entradas diversas para produzir imagens com maior exatidão do que os modelos tradicionais voltados apenas à imagem.

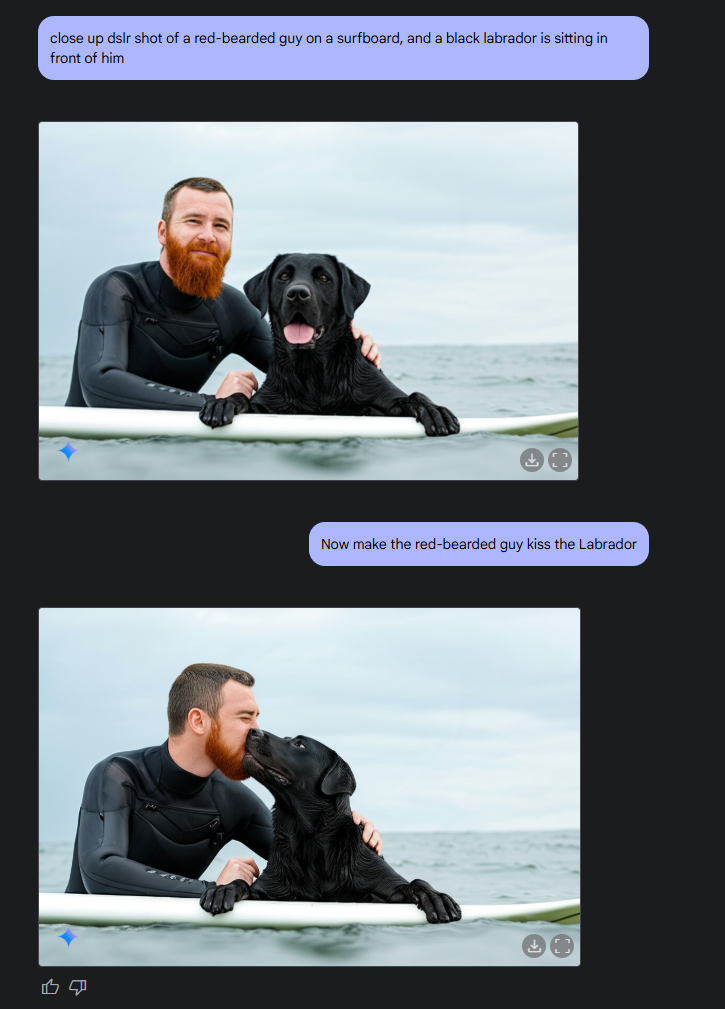

O modelo demonstra, em diversas situações, uma precisão impressionante ao converter comandos textuais em imagens. Segundo o Google, ele é capaz de criar narrativas visuais consistentes ao combinar texto e imagens, mantendo a integridade de personagens e cenários em múltiplas produções. Além disso, permite a edição de imagens de maneira interativa por meio de vários passos de diálogo, facilitando aprimoramentos iterativos sem perder o contexto da conversa.

A OpenAI deve lançar recursos multimodais de imagem em março

A OpenAI já demonstrou o potencial dessa tecnologia com o seu modelo GPT-4o, apresentado em maio de 2024. Assim como o Gemini, o GPT-4o foi desenvolvido como um sistema nativo multimodal, capaz de processar entradas de texto, áudio, imagem e vídeo e gerar saídas variadas, como textos, áudios e imagens.

A empresa expôs uma série de funcionalidades que vão desde a criação de narrativas visuais e designs detalhados de personagens até a aplicação de tipografia criativa e renderização 3D realista. Embora esses recursos ainda não estejam disponíveis ao público, fontes do setor indicam que a OpenAI deverá lançá-los em março de 2025 – um cenário ainda mais provável após o anúncio do Google. Funcionários da OpenAI também já insinuaram próximas funcionalidades para geração de imagens.

- O Google lançou uma versão experimental do modelo Gemini 2.0 Flash, que entende comandos textuais e gera imagens automaticamente.

- A capacidade do Gemini reside no processamento simultâneo de texto, na análise lógica do conteúdo e na interpretação de imagens, permitindo resultados visuais mais precisos e realistas.

- O modelo destaca-se por manter a consistência em personagens e cenários em múltiplas imagens, integrando de forma precisa elementos textuais às imagens geradas.

Matthias é cofundador e editor do THE DECODER, explorando como a inteligência artificial está transformando a relação entre humanos e computadores.