Dans le projet « Voyant le Monde à travers vos Yeux », des chercheurs de l’Université du Maryland, College Park, montrent que les reflets de l’œil humain peuvent être utilisés pour reconstruire des scènes en 3D. Selon eux, cela constitue une « source sous-estimée d’informations sur l’apparence du monde qui nous entoure ».

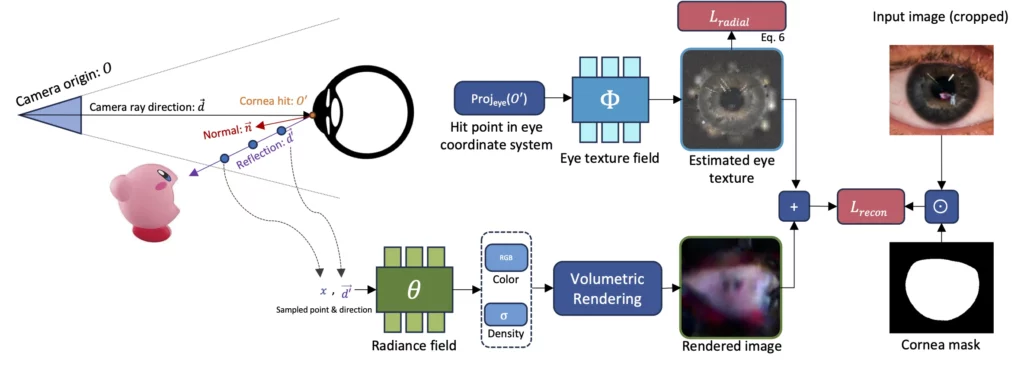

L’article utilise une méthode basée sur NeRF pour reconstruire une scène en 3D à partir d’un reflet dans l’œil. Cela semble simple, mais c’est en réalité un processus complexe qui implique plusieurs facteurs, notamment la détermination précise de la direction du regard et la distinction entre les reflets et les motifs dans l’iris, affirment les chercheurs.

Calcul de l’environnement extérieur à travers la cornée

Pour calculer le monde extérieur, l’équipe utilise la géométrie de la cornée, qui est assez uniforme chez les adultes en bonne santé. En se basant sur la taille de la cornée dans une image, ils peuvent estimer la position et l’orientation de l’œil.

Un aspect important est d’optimiser la détection de la position de la cornée, qui est utilisée pour affiner l’estimation de la position initiale pour chaque image. Cette technique s’est révélée essentielle pour la robustesse de la méthode.

Pour séparer le reflet du monde extérieur du motif de l’iris, l’équipe a utilisé un cadre d’apprentissage modifié de Nerfstudio. Ils ont fait en sorte que NeRF apprenne à la fois la scène 3D réfléchie et le motif de l’iris, et ont formé le système simultanément pour séparer les deux éléments.

Pour la détection de l’iris, le système a reçu la forme générale symétrique radiale comme motif et l’hypothèse selon laquelle le reflet change de perspectives différentes, mais la texture de l’iris reste la même.

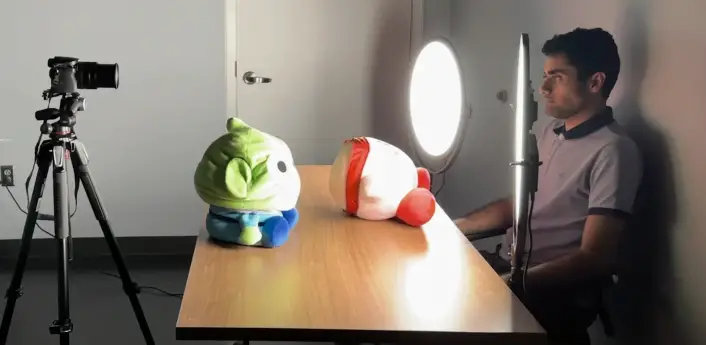

NeRF 3D avec seulement une caméra

Alors que les reconstructions typiques de NeRF nécessitent plusieurs vues de la caméra de l’objet en cours de reconstruction, les chercheurs ont simplement déplacé la personne dans le champ de vision de la caméra. Les reflets dans les yeux, qui changent même avec de légers mouvements, ont fourni les différentes perspectives nécessaires pour reconstruire la scène en 3D, même si une seule caméra a capturé la personne.

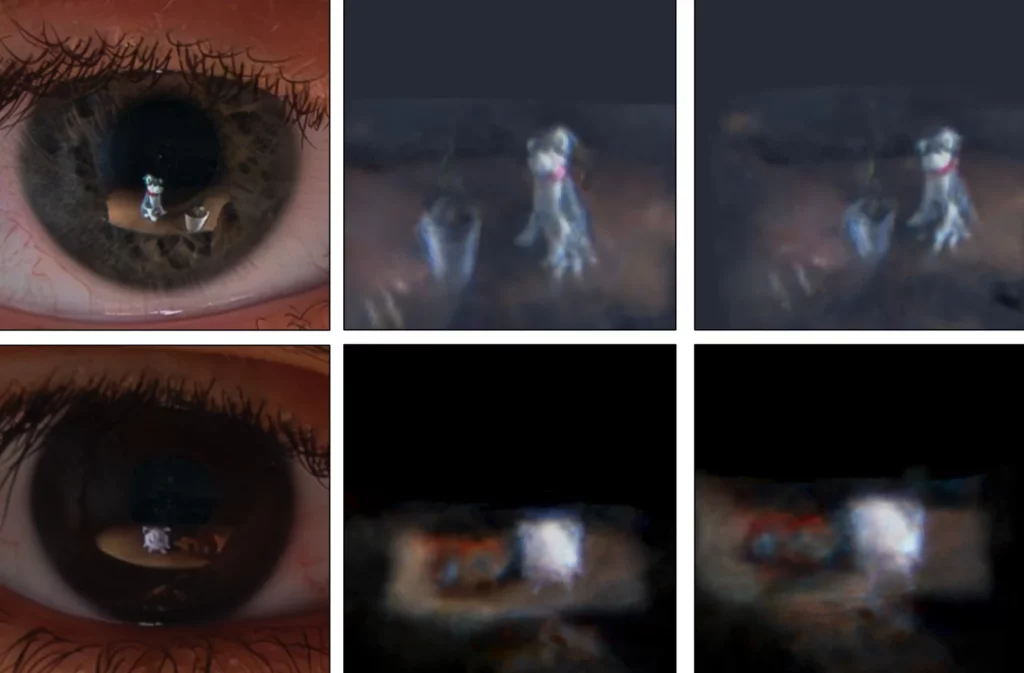

Pour valider leur méthode, l’équipe a utilisé des images synthétiques d’yeux rendues avec Blender et des photographies réelles d’une personne se déplaçant dans le champ de vision de la caméra. Malgré les défis tels que les imprécisions dans la localisation de la cornée et l’estimation de sa géométrie, ainsi que la résolution intrinsèquement faible des images, leur méthode a montré des promesses, affirment les chercheurs. Lors de tests avec des modèles synthétiques d’yeux, l’équipe a réussi à réaliser des reconstructions complètes de la scène en utilisant uniquement les reflets dans les yeux.

Cependant, les tests ont été menés uniquement en laboratoire ; dans la réalité, de nombreux autres facteurs entrent en jeu et les hypothèses formulées dans l’article, telles que la texture de l’iris, peuvent être trop simplistes. Des textures plus lumineuses dans l’iris ou des situations impliquant une rotation prononcée des yeux peuvent présenter des défis supplémentaires, écrivent les chercheurs.

L’équipe espère que ce travail encouragera davantage de recherches sur la manière dont des signaux visuels inattendus et aléatoires peuvent être utilisés pour révéler des informations sur le monde qui nous entoure.