Normalmente, nadie responde cuando hablas solo. La IA puede llenar ese vacío.

En un hilo del subreddit r/singularity, un usuario presentó su último proyecto: un gran modelo lingüístico que entrenó con 100 horas de entrevistas realizadas por él mismo. Ahora, el usuario UsedRow2531 puede realizar entrevistas con una «versión fantasmal local» de sí mismo.

Explicó que el proyecto implicó mucha experimentación y «muchas noches hablando conmigo mismo». Subrayó que el éxito del proyecto dependía menos del método y más de la calidad del corpus de entrevistas.

La metodología no importa, el corpus es crucial

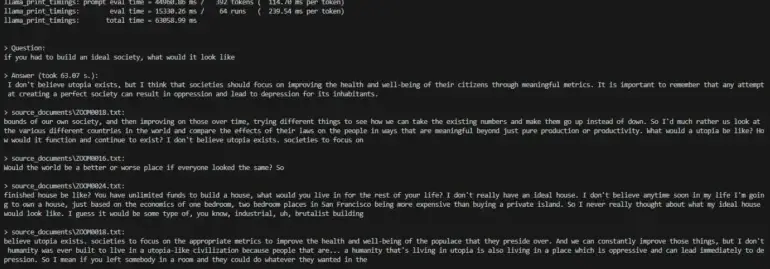

Eligió el modelo Vicuna tras obtener «resultados extraños» con Metas LLaMA 2 (llama-2-70b-hf). No estaba seguro de si se debía a modificaciones incorrectas o a que el modelo no hacía realmente lo que se suponía que debía hacer.

Por si fuera poco, su modelo también puede indicar la fuente, lo que permite rastrear de qué periodo de tiempo procede la respuesta.

Google, ingeniería y muchas noches hablando solo como un loco. El método no importa. Lo que importa es la calidad del corpus de entrevistas. Con un conjunto de datos masivo, el «cómo» no tiene sentido. Este modelo se ha entrenado conmigo hasta 2019. Aún no lo he alimentado con datos de 2019 a 2023. Es puramente una prueba de concepto para asegurarme de que voy por el buen camino.

u/UsedRow2531 en Reddit

El post recibió una respuesta positiva de la comunidad de Reddit. Muchos usuarios quedaron impresionados y pidieron instrucciones específicas sobre cómo crear un «gemelo digital» de sí mismos. Otros preguntaron por posibles aplicaciones para proyectos similares, incluida la posibilidad de entrenar un modelo de IA con correos electrónicos personales.

¿Nuevas herramientas también para historiadores e investigadores?

Los debates en torno a la contribución de UsedRow2531 también dieron lugar a reflexiones filosóficas sobre el futuro de las autobiografías y los registros personales.

El usuario u/Pelumo_64 especuló con la posibilidad de que una persona recopilara sus pensamientos en un diario digital, con texto generado a partir de grabaciones de audio según fuera necesario. Este texto se convertiría en un bot interactivo capaz de responder preguntas.

Las preguntas podrían versar sobre la vida cotidiana o las creencias de la persona. Según u/Pelumo_64, un bot así podría ser una valiosa herramienta para que antropólogos, historiadores e investigadores criminales profundizaran en los pensamientos y la vida cotidiana de las personas.

El «fantasma» también tiene alucinaciones

Sin embargo, el proyecto reproduce las conocidas deficiencias de los modelos lingüísticos convencionales. Estas deficiencias pueden no ser un problema en el ámbito privado, pero también demuestran que es poco probable que la profesión del biógrafo profesional desaparezca pronto.

A pesar de la cuidadosa selección de la base de datos, el modelo de IA mostró algunos comportamientos inesperados. Entre otras cosas, repitió varias veces que era un genio y que creía en la existencia de extraterrestres. Estos eran aspectos que el usuario u/UsedRow2531 nunca mencionó en sus entrevistas originales.

Yo nunca dije eso. Lo comprobé todo. Se distorsiona cuando lo corrijo. LLM analiza de algún modo lo que dije y decide que soy un genio. No soy un genio, ni lo considero un genio. Todo muy extraño.

u/UsedRow2531 en Reddit

El usuario u/More_Grocery-1858 tiene una respuesta plausible: el modelo funciona con probabilidades estadísticas y, por tanto, reconoce las diferentes conexiones entre palabras.

Las personas que dijeran cosas similares a las del autor original también se llamarían a sí mismas genios. Esto conduce al efecto mostrado, incluso si el autor del tema inicial no se llama a sí mismo genio.

El concepto no es realmente nuevo. A finales de 2022, a un artista se le ocurrió alimentar GPT-3 con entradas de diarios de su infancia para conocerse mejor a sí mismo. ¿Y qué dice el propio inventor u/UsedRow2531 sobre el proyecto? «El futuro va a ser raro»

Con contenido de The Decoder.