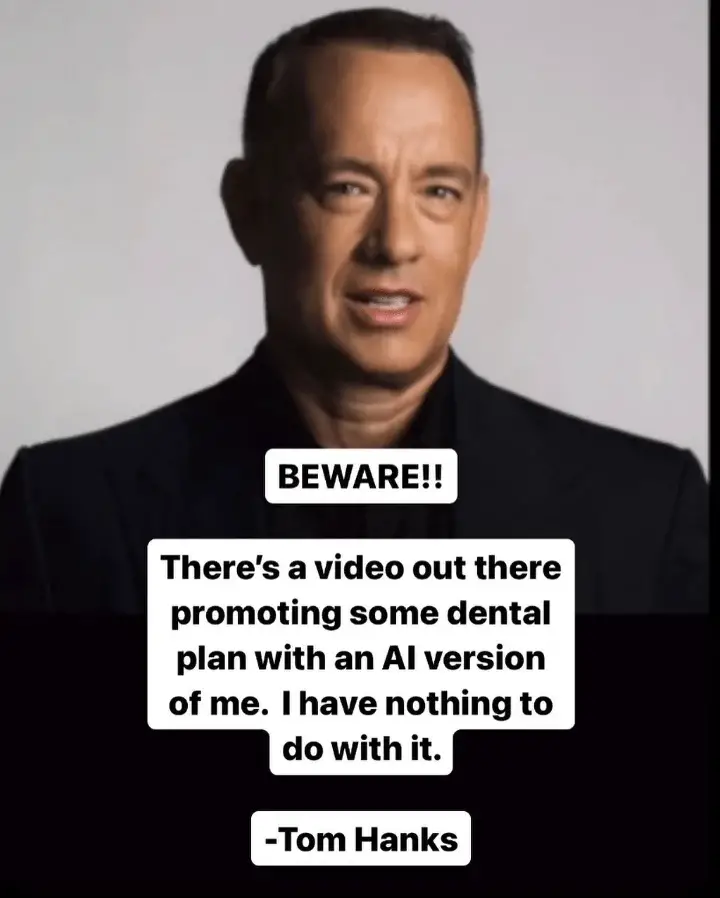

Una «versión IA» de Tom Hanks promociona un seguro dental sin el permiso del actor. El actor advierte de la estafa en sus redes sociales.

En su canal oficial de Instagram, Tom Hanks advierte de una «versión IA» de sí mismo que promociona un seguro dental. Ha publicado una captura de pantalla del vídeo: «¡Cuidado! […] No tengo nada que ver con esto», escribe Hanks en la captura de pantalla del vídeo, que muestra a un Tom Hanks más joven.

om Hanks advierte contra una «versión IA» que anuncia planes dentales | Imagen: Tom Hanks/screenshot on Instagram

Algo parecido ocurrió en Alemania con los presentadores de informativos Christian Sievers y André Schünke, que se convirtieron en protagonistas involuntarios de la publicidad en redes sociales de un dudoso producto de inversión en IA.

La estafa deepfake: fama y mucho material visual y sonoro

En los casos anteriores, se cumplen las condiciones ideales para las estafas deepfake: las víctimas tienen muchos vídeos y audio de sí mismas en la red para entrenar a los sistemas de IA. Y tienen caras conocidas, por lo que los anuncios tienen un fuerte impacto.

Pero eso no significa que las personas menos conocidas estén a salvo de las deepfakes: el entrenamiento de datos para los sistemas de IA es cada vez más eficiente. Para la clonación de voz, bastan unos segundos de tu voz para generar un gemelo digital creíble.

Si realmente quieres estar a salvo de los clones de IA, no publiques fotos ni sonidos tuyos en Internet y elimina todo lo que hayas publicado hasta ahora.

Por supuesto, esto no va a suceder, así que será mejor que nos acostumbremos a la posibilidad de deepfakes y tratemos de consumir medios de comunicación principalmente de los canales oficiales. En este caso, los anunciantes de las redes sociales también son responsables, porque necesitan métodos para garantizar que los anuncios no violan los derechos personales de la gente.

En este sentido, la predicción de Ian Goodfellow, el inventor de la técnica de imágenes GAN, la tecnología deepfake original, parece hacerse realidad. En 2017, predijo que la gente ya no podría creer imágenes y vídeos en la web debido a las nuevas capacidades técnicas.

Hao Li, un informático especializado en IA y deepfakes que ha trabajado en la industria cinematográfica durante muchos años, cree que los deepfakes alcanzarán un nivel de perfección en el que ni el ojo humano ni los detectores de las máquinas podrán distinguirlos del original. En última instancia, afirma, los vídeos, incluidos los deepfakes, no son más que píxeles con valores de color específicos.