STEVE-1 es un modelo generativo de IA que puede realizar tareas en Minecraft utilizando instrucciones basadas en texto.

Los modelos de IA que pueden responder a instrucciones en lenguaje natural se han hecho increíblemente populares, pero crear modelos capaces de seguir instrucciones para tareas secuenciales complejas sigue siendo un reto. Los investigadores acaban de presentar STEVE-1, un asistente de IA capaz de seguir una amplia variedad de instrucciones breves y visuales en Minecraft.

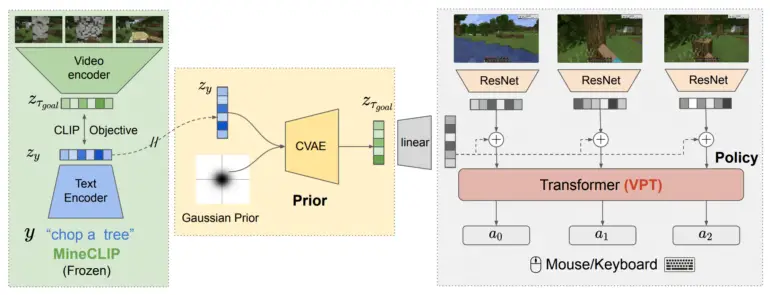

STEVE-1 se basa en dos modelos de IA ya existentes: VPT, un modelo fundamental preentrenado en 70.000 horas de juego de Minecraft, y MineCLIP, que alinea los pies de texto con los vídeos de Minecraft. Inspirándose en el método unCLIP de DALL-E 2, los investigadores ajustaron el VPT para que siguiera los objetivos visuales codificados por MineCLIP y, a continuación, entrenaron un módulo para traducir las indicaciones de texto en incrustaciones visuales de MineCLIP.

Este modelo en dos pasos permite a STEVE-1 seguir instrucciones tanto textuales como visuales en Minecraft, utilizando sólo 60 dólares de potencia de cálculo y 2.000 ejemplos etiquetados.

STEVE-1 supera con creces a los anteriores agentes de IA en Minecraft. En las pruebas realizadas, STEVE-1 superó con creces a los agentes de IA anteriores en Minecraft cuando se le daban instrucciones relevantes, recogía muchos más recursos y exploraba más, además de ser capaz de realizar varias tareas a corto plazo, como talar árboles, recoger recursos y explorar, cuando se le pedía con texto o imágenes.

Los investigadores descubrieron que encadenar instrucciones mejoraba el rendimiento en tareas a largo plazo, como crear objetos o construir estructuras, de casi cero a una tasa de éxito de entre el 50 y el 70 por ciento. El equipo también demostró que STEVE-1 responde a instrucciones humanas en tiempo real, lo que demuestra su potencial como asistente interactivo.

STEVE-1 es un modelo para «agentes instruibles en dominios más allá de Minecraft»

Aunque, al igual que en la creación de imágenes, cambiar a una instrucción más larga y específica mejora drásticamente el rendimiento de STEVE-1 en tareas de larga duración, esto también es intuitivo y requiere mucho tiempo, por lo que hay que seguir trabajando en ello, como menciona el artículo.

Según el equipo, al trabajar directamente a partir de la entrada de píxeles en bruto y de acciones de ratón y teclado de bajo nivel, el método podría aplicarse más ampliamente para crear agentes instruibles en dominios distintos de Minecraft. El trabajo futuro se centrará en mejorar la capacidad de STEVE-1 para manejar instrucciones más largas y complejas mediante la incorporación de grandes modelos de lenguaje que ayuden al agente a planificar y ejecutar tareas de varios pasos.

Más información y el código en la página del proyecto STEVE-1.

Regenerar respuesta