ChatGPT tiene ojos a través de GPT-4V y ahora puede analizar gráficos, fotos y cualquier otro tipo de contenido visual. Esto abre nuevas posibilidades.

Aproximadamente medio año después de anunciar la versión multimodal de GPT-4, ahora llamada GPT-4V(isión), OpenAI pone finalmente esta función a disposición de los clientes de pago de ChatGPT. En poco tiempo, los usuarios han estado explorando las posibilidades de lo que se puede hacer con ChatGPT utilizando indicaciones combinadas de imagen y texto. Estos son los ejemplos más interesantes que hemos encontrado hasta ahora.

Desarrollo front-end

Uno de los casos de uso más populares para los grandes modelos lingüísticos es la programación. Aquí es donde entran en juego las nuevas funciones multimodales de ChatGPT. Por ejemplo, GPT-4V puede reconstruir el panel de control de un sitio web a partir de capturas de pantalla o dibujos.

Vídeo: @mckaywrigley/Twitter

La herramienta de IA parece imitar la estructura dada casi a la perfección, incluso tomando los datos del modelo 1:1 como marcadores de posición. Sólo los detalles de diseño, como colores, formas y tipos de letra, son diferentes. Sin embargo, GPT-4V puede reducir significativamente el tiempo de desarrollo desde el diseño hasta el prototipo en este ámbito.

Vídeo: @mckaywrigley/Twitter

Matt Shumer, CEO de la startup de IA HyperWrite, ha ido un paso más allá y ha combinado GPT-4V con el concepto de AutoGPT. En este caso, la IA utiliza el resultado de una ejecución como indicador para la siguiente, lo que le permite mejorar continuamente el código por sí misma.

Vídeo: @mattshumer_/Twitter

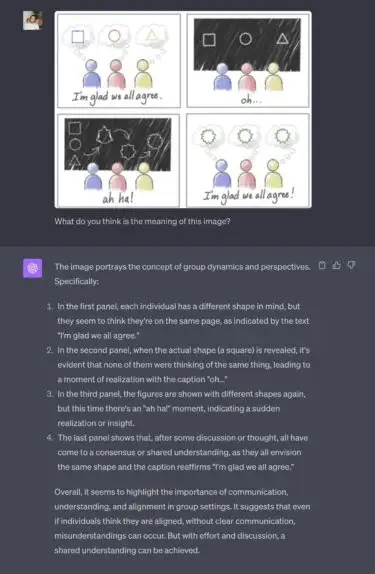

Explicar cómics, memes o infografías

GPT-4V puede explicar lo que se muestra y lo que significa una imagen. Ya se trate de una viñeta, un cómic o un meme de Twitter, ChatGPT describirá primero la imagen en detalle, incluidos los pies de foto, y luego explicará, por ejemplo en el caso de imágenes humorísticas, por qué el contenido puede entenderse como gracioso.

Twitter: @skirano/Twitter

Imagen: @rcweston/Twitter

Ayudar con los deberes

La IA desempeña un papel importante en la educación, entre otras cosas porque los estudiantes utilizan ChatGPT y similares como herramientas. La multimodalidad puede tener un gran impacto en la utilidad de los grandes modelos lingüísticos en este contexto.

Como demuestra Mckay Wrigley en Twitter, GPT-4V puede analizar fácilmente incluso infografías complejas como este etiquetado de una célula humana. En su ejemplo, tiene la célula explicada a un nivel de noveno grado y puede seguir con preguntas más profundas.

Vídeo: @mckaywrigley/Twitter

El modelo también puede descomponer infografías en explicaciones de texto sencillas, como muestra Muratcan Koylan.

imagen: Muratcan Koylan/@youraimarketer

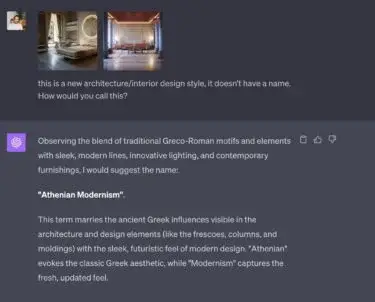

Dar consejos sobre diseño de interiores o visualizar los efectos de las setas psicodélicas

Además de gráficos, GPT-4V también puede procesar fotos o imágenes generadas por IA. En este ejemplo, el usuario de Twitter Pietro Schirano introdujo imágenes generadas por la IA y pidió a ChatGPT un nombre para este estilo de interior, que la IA proporcionó rápidamente con una explicación razonable.

Imagen: @skirano/Twitter

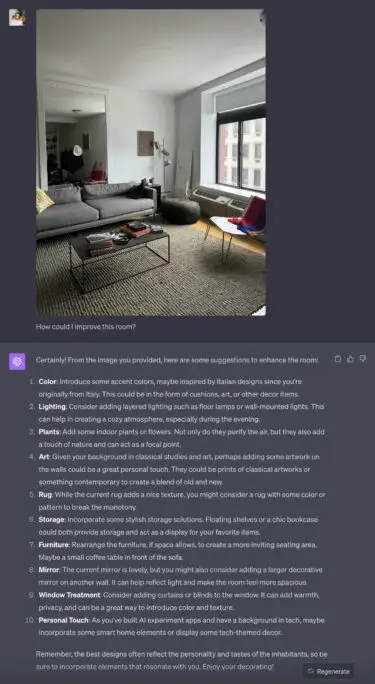

Schirano destaca el potencial de la IA personalizada con otro ejemplo. Almacenó cierta información sobre sí mismo en las instrucciones personalizadas, que ChatGPT tiene en cuenta a la hora de evaluar su interior.

Imagen: @skirano/Twitter

El siguiente ejemplo muestra una interesante combinación de ejemplo de imagen, descripción de imagen y generación de imagen resultante: el usuario de Twitter Pietro Schirano muestra primero a GPT-4V una foto de setas psicodélicas. Sin decirle al sistema qué setas son, pregunta a GPT-4V cómo se sentiría después de comerlas.

El sistema proporciona una descripción adecuada y, a continuación, puede definir las alucinaciones según sea necesario en una pregunta de imagen que genera la siguiente salida a través de DALL-E 2.

Con el lanzamiento de DALL-E 3 en octubre para todos los usuarios de pago de ChatGPT, este flujo de trabajo debería ser posible directamente en ChatGPT Plus, y con una calidad mucho mayor.

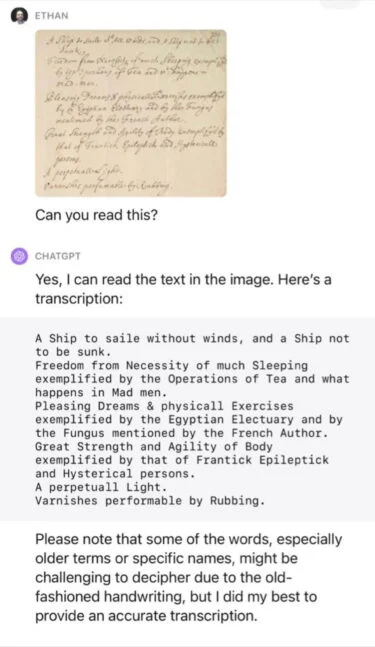

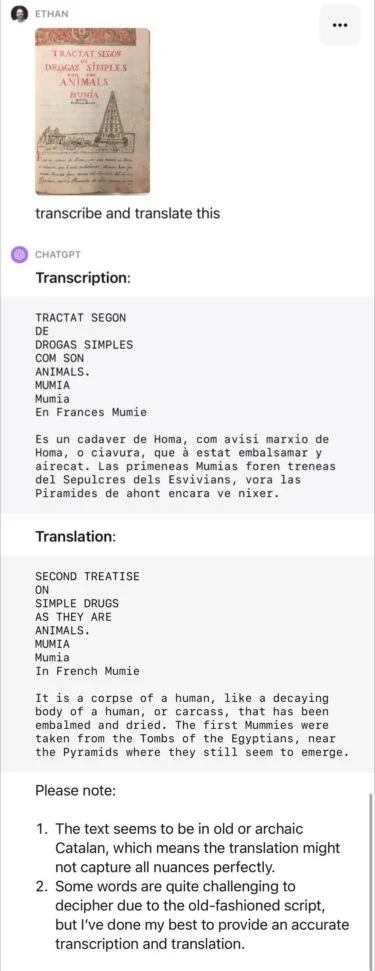

Descifrar escritura ilegible

El OCR (reconocimiento óptico de caracteres) es sólo una pequeña parte de GPT-4V, pero sus capacidades son inmensas. A los historiadores les interesará saber que la GPT-4V puede descifrar y traducir manuscritos históricos. «Las humanidades están a punto de cambiar de forma radical», afirma el investigador Ethan Mollick tras utilizar la GPT-4V para convertir, traducir y analizar las notas centenarias de Robert Hooke.

¿Cómo se utiliza GPT-4V?

GPT-4V requiere una suscripción de pago a ChatGPT-Plus por 20 dólares al mes. Una vez suscrito, puedes subir imágenes a través del sitio web y de la aplicación para smartphone. La aplicación te permite subir varias imágenes a la vez y resaltar áreas específicas de la imagen. OpenAI está lanzando GPT-4V por fases. Así que, aunque tengas una suscripción de pago, es posible que aún no tengas acceso a ella.