A OpenAI apresenta um modelo de IA que atinge o estado-da-arte (SOTA) na resolução de alguns problemas matemáticos. O processo subjacente poderia levar a modelos de linguagem melhores em geral.

No artigo intitulado “Let’s Verify Step by Step”, a equipe da OpenAI treinou vários modelos baseados no GPT-4 para resolver problemas no conjunto de dados MATH. O objetivo era comparar duas variantes de processos de feedback para treinar modelos de recompensa.

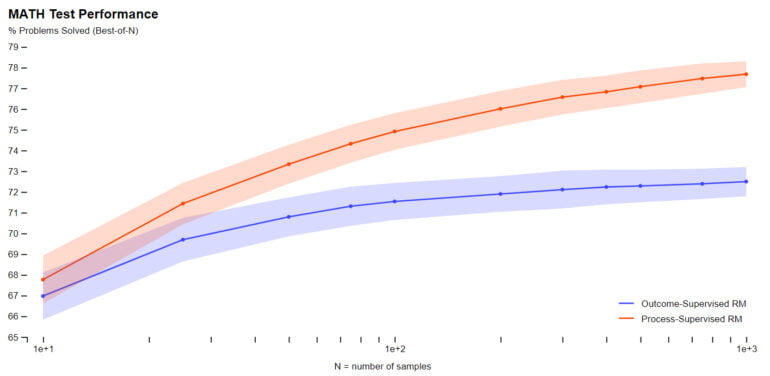

Especificamente, a equipe comparou a “supervisão de resultado”, na qual o modelo de IA recebe feedback sobre o resultado final de uma tarefa, com a “supervisão de processo”, na qual o modelo recebe feedback em cada etapa específica de raciocínio. Na prática, o último processo requer feedback humano e, portanto, é custoso para modelos grandes e tarefas diversas – o trabalho atual é, portanto, uma investigação que poderia determinar a direção futura da OpenAI.

Supervisão de processo: como evitar impostos de alinhamento

Para tarefas matemáticas, a OpenAI demonstrou que a supervisão de processo produz resultados significativamente melhores tanto para modelos grandes quanto para modelos pequenos, o que significa que os modelos estão corretos com mais frequência e também apresentam um processo de pensamento mais semelhante ao humano, de acordo com a equipe. Alucinações ou erros lógicos, que são comuns mesmo nos melhores modelos atualmente, podem ser reduzidos.

Além disso, de acordo com a OpenAI, recompensar os passos intermediários corretos evita o fenômeno conhecido como “imposto de alinhamento”, no qual o desempenho de um modelo é reduzido devido à sua aderência aos valores e expectativas humanas. No caso das tarefas matemáticas testadas, a empresa até mesmo constatou uma diminuição do imposto de alinhamento.

“É desconhecido quão amplamente esses resultados se generalizarão além do domínio da matemática, e consideramos importante que trabalhos futuros explorem o impacto da supervisão do processo em outros domínios. Se esses resultados se generalizarem, podemos descobrir que a supervisão do processo nos oferece o melhor dos dois mundos – um método que é tanto mais eficiente quanto mais alinhado do que a supervisão do resultado.”

OpenAI

OpenAI disponibiliza conjunto de dados rotulados por humanos

A aplicabilidade da supervisão do processo em domínios fora da matemática precisa ser ainda mais explorada. Para auxiliar nesse processo, a OpenAI lançou o conjunto de dados PRM800K utilizado em seu próprio modelo, que contém 800.000 rótulos humanos para todas as etapas intermediárias no conjunto de dados MATH.

O co-autor e co-fundador da OpenAI, John Schulman, recentemente proferiu uma palestra detalhando o papel central dos modelos de recompensa na moldagem de comportamentos desejados em grandes modelos de linguagem.