OpenAI a présenté GPT-4 comme un modèle multimodal avec compréhension des images, mais n’a pas encore publié la partie image du modèle. MiniGPT-4 est disponible dès aujourd’hui en tant que modèle open source.

MiniGPT-4 est un chatbot qui comprend les images. Cette fonctionnalité a été introduite par OpenAI lors du lancement de GPT-4, mais n’a pas encore été diffusée en dehors de l’application Be my Eyes.

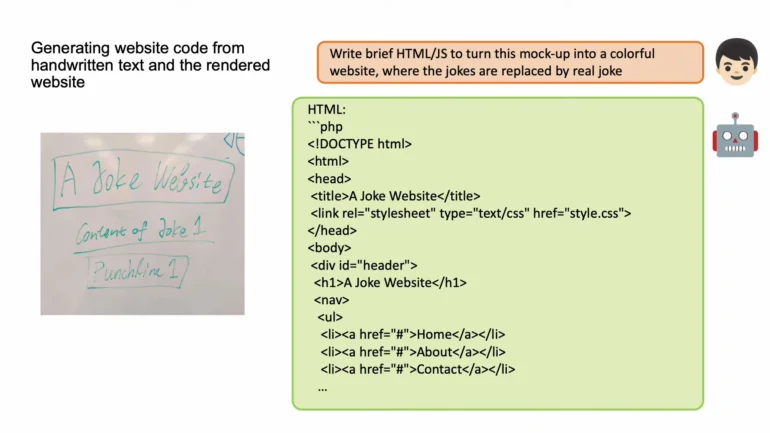

Comme son homologue plus grand, MiniGPT-4 peut décrire des images ou répondre à des questions sur le contenu d’une image : par exemple, étant donné une image d’un plat préparé, le modèle peut produire une recette (éventuellement) correspondante (voir l’image vedette) ou générer une description d’image appropriée pour les personnes malvoyantes. À l’instar de la nouvelle fonction « /describe » de Midjourney, MiniGPT-4 peut extraire des messages-guides d’images, ou au moins quelques idées. Selon les chercheurs, la fonction « image-to-website » d’OpenAI, présentée lors du lancement de GPT-4, peut également être utilisée avec MiniGPT-4.

« Nos résultats révèlent que MiniGPT-4 traite de nombreuses fonctions similaires à celles de GPT-4, telles que la génération de descriptions d’images détaillées et la création de sites web à partir de croquis manuscrits », peut-on lire dans l’article.

L’équipe de développement a mis le code, les démonstrations et les instructions de formation de MiniGPT-4 à disposition sur Github. Elle annonce également une version plus petite du modèle qui fonctionnera avec une seule carte graphique Nvidia 3090. La vidéo ci-dessous montre quelques exemples.

L’IA open source est en plein essor

L’aspect remarquable du MiniGPT-4 est qu’il est basé sur le LLM Vicuna-13B et le modèle de langage de vision BLIP-2, des logiciels libres qui peuvent être entraînés et réglés pour un coût relativement faible et sans avoir recours à des données massives et à une surcharge de calcul.

L’équipe de recherche a d’abord entraîné MiniGPT-4 avec environ cinq millions de paires image-texte en dix heures sur quatre cartes Nvidia A100. Dans un deuxième temps, le modèle a été affiné avec 3 500 paires texte-image de haute qualité générées par une interaction entre MiniGPT-4 et ChatGPT. ChatGPT a corrigé les descriptions d’images incorrectes ou imprécises générées par MiniGPT-4.

Corrigez l’erreur dans le paragraphe donné. Supprimez les phrases répétées, les caractères absurdes, les phrases non anglaises, etc. Supprimez les répétitions inutiles. Réécrire les phrases incomplètes. Renvoyer directement les résultats sans explication. Renvoyer directement le paragraphe d’entrée s’il est déjà correct, sans explication.

Invite ChatGPT dans MiniGPT-4

Cette deuxième étape a considérablement amélioré la fiabilité et la facilité d’utilisation du modèle – et n’a nécessité que sept minutes d’entraînement sur un seul Nvidia A100. Les chercheurs eux-mêmes se sont dits surpris par l’efficacité de leur approche.

Le modèle linguistique MiniGPT-4 Vicuna suit la « formule alpaga » et utilise les résultats de ChatGPT pour affiner un modèle linguistique Meta de la famille LLaMA. Vicuna est censé être à la hauteur de Google Bard et de ChatGPT, là encore avec un effort de formation relativement faible.

MiniGPT-4 est un autre exemple des progrès rapides réalisés par la communauté open source en très peu de temps. Cela suggère que le fossé qui sépare les entreprises de modèles d’IA pure n’est peut-être pas si grand : hier, le chatbot open source OpenAssistant a été lancé, formé avec des données pédagogiques collectées auprès de volontaires et destiné à devenir une alternative ouverte à ChatGPT à terme.

Compte tenu de cette évolution, il serait logique que l’OpenAI se concentre d’abord sur la construction d’un écosystème de partenaires utilisant des plugins ChatGPT pour le GPT-4, plutôt que de former le GPT-5 dès maintenant. L’effort de recherche et de formation pour un nouveau modèle peut être plus important pour OpenAI que l’avantage qu’elle peut en tirer par rapport à ses concurrents ou à la communauté open source. En comparaison, la mise en place d’un écosystème de chat est plus difficile et économiquement non viable. Il peut également avoir un fort effet de verrouillage sur les utilisateurs.