DragGAN: ¿Una nueva era en la edición de imágenes?

El DragGAN abre una nueva categoría en la edición de imágenes, donde las imágenes fotorrealistas son personalizadas por el usuario a través de la función de arrastrar y soltar. Los detalles son manipulados por una GAN (Red Generativa Antagónica).

Los métodos actuales de manipulación de imágenes, como herramientas como Photoshop, requieren un alto grado de habilidad para controlar de manera flexible y precisa la posición, forma, expresión o disposición de objetos individuales. Otra opción es crear imágenes completamente nuevas utilizando IA generativa, como Stable Diffusion o GANs, pero estas opciones ofrecen poco control.

Con DragGAN, investigadores del Instituto Max Planck de Ciencias de la Computación, el Centro de Investigación en Visión por Computadora de Saarbrücken, el MIT CSAIL y Google demuestran una nueva forma de controlar GANs para el procesamiento de imágenes.

Actualización de junio de 2023: Existe una demostración para DragGAN y el código fuente ahora está disponible en GitHub.

DragGAN: Procesamiento de imágenes mediante arrastrar y soltar

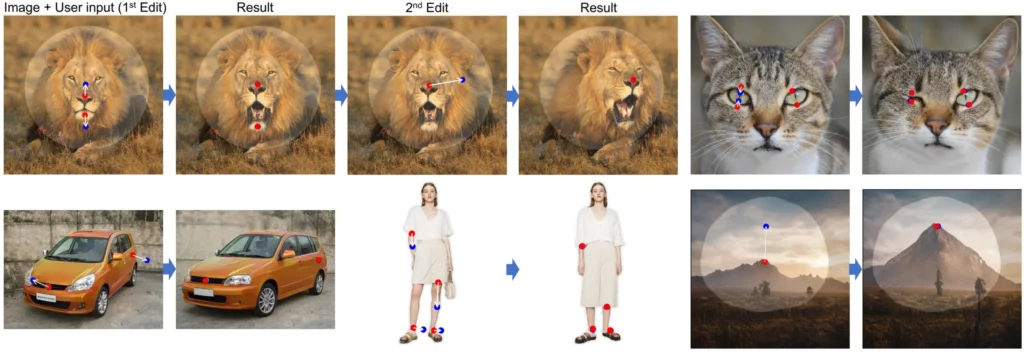

DragGAN puede procesar imágenes fotorrealistas siempre que las representaciones correspondan a las categorías del conjunto de datos de entrenamiento de la GAN. Esto incluye animales, automóviles, personas, células y paisajes. En una interfaz sencilla, los usuarios arrastran puntos definidos en una imagen a las posiciones deseadas, por ejemplo, cerrar los ojos de un gato, girar la cabeza de un león y abrir su boca, o transformar un automóvil en otro modelo.

El DragGAN ofrece un nuevo nivel de control y personalización en la edición de imágenes, permitiendo a los usuarios manipular los detalles de una manera intuitiva y fácil. Esto tiene el potencial de revolucionar la forma en que interactuamos con las imágenes y abre nuevas posibilidades creativas en el campo de la edición de imágenes.

El DragGAN rastrea estos puntos y genera imágenes correspondientes a los cambios deseados.

El DragGAN produce resultados realistas para escenarios desafiantes

«A través de DragGAN, cualquier persona puede deformar una imagen con un control preciso sobre dónde van los píxeles, manipulando así la pose, forma, expresión y diseño de diversas categorías», dijo el equipo. «Como estas manipulaciones se realizan en el espacio generativo de imagen aprendido por una GAN, tienden a producir resultados realistas, incluso para escenarios desafiantes, como alucinar contenido oculto y deformar formas que siguen consistentemente la rigidez del objeto».

En una comparación, el equipo demuestra que el DragGAN es claramente superior a otros enfoques. Sin embargo, algunos cambios aún presentan artefactos cuando están fuera de la distribución de entrenamiento.

Características del Editor de Fotos DragGAN

DragGAN es una tecnología de vanguardia que ofrece una alteración interactiva de imágenes basada en puntos. Esta aplicación avanzada tiene varias capacidades que llevan la edición de imágenes a un nivel completamente nuevo.

Control Excepcional: Con la herramienta de edición de IA DragGAN, los usuarios tienen un control preciso sobre la distorsión de la imagen. En lugar de realizar ajustes amplios e inexactos, esta tecnología permite a los usuarios editar píxeles con una precisión milimétrica, asegurando el efecto deseado.

Versatilidad: La versatilidad de DragGAN es notable. Permite a los usuarios cambiar las fotos de diversas formas, incluyendo posturas, formas, emociones y diseños. Debido a su flexibilidad, es una excelente herramienta para una amplia gama de tareas de edición de imágenes.

Eficiencia: Cuando se trata de la edición de imágenes, el tiempo es crucial, y DragGAN destaca en este aspecto. Trabaja rápidamente, a menudo solo necesita unos segundos para modificar una imagen. Esta eficiencia garantiza que las tareas de edición de los usuarios se completen de manera eficiente y efectiva.

Alta Precisión: Los resultados realistas son fundamentales en la edición de imágenes, y DragGAN sobresale en esto. Destaca en condiciones difíciles, como la generación de contenido para áreas ocultas y la deformación de formas mientras se mantiene la rigidez del objeto. Este alto grado de precisión lo convierte en una herramienta confiable para aplicaciones que requieren cambios visuales exactos y realistas.

Descargar la herramienta de edición de IA DragGAN

DragGAN aún está en desarrollo y no está disponible para su descarga. Según los creadores, el software estará disponible en junio de 2023. Regístrate en su lista de correo electrónico para mantenerte informado sobre el lanzamiento y la disponibilidad de DragGAN. Unirse a la lista de correo te permitirá recibir alertas y ser uno de los primeros en saber cuándo el programa esté listo para descargar.

Cómo instalar y usar la herramienta de edición de IA DragGAN en Ubuntu

Aunque no se recomienda instalar y utilizar oficialmente la herramienta de edición de IA DragGAN en este momento, algunos desarrolladores se han esforzado por instalar y experimentar con DragGAN AI. En este tutorial, te mostraremos cómo instalar y ejecutar el código de DragGAN AI utilizando una versión de GitHub en un servidor Ubuntu 22.04 con GPU Tesla T4, 2vCPU, 7,5 GB de RAM, 50 GB de espacio en disco y el inicio seguro desactivado en Google Cloud.

Esta configuración de la herramienta de edición de IA DragGAN se ha probado en Google Cloud con las configuraciones mencionadas anteriormente. Si deseas utilizar una GPU diferente, puedes instalar el controlador Nvidia correspondiente para tu GPU.

Configurar el servidor para DragGAN en Ubuntu 22.04

Sigue el artículo a continuación para configurar la arquitectura de aprendizaje profundo con Nvidia, CUDA, cuDNN y Anaconda 3 antes de instalar la herramienta de edición de DragGAN.

Requisitos previos

Configurar la arquitectura de aprendizaje profundo con Nvidia, Cuda, cuDNN, Anaconda

Sigue los pasos hasta instalar Anaconda3. No es necesario instalar TensorFlow o PyTorch. Vamos a instalar todos los paquetes de Python necesarios como se menciona a continuación.

Clonar el repositorio de GitHub

Ahora puedes clonar el repositorio desde GitHub utilizando el comando git clone.

git clone https://github.com/Zeqiang-Lai/DragGAN.git

Navega dentro del directorio.

cd DragGAN

Crea el entorno de Conda

Ahora puedes crear el entorno de Anaconda y comenzar a instalar los paquetes.

conda create -n draggan python=3.7

conda activate draggan

pip install -r requirements.txtEsto tomará algún tiempo para descargar todos los paquetes requeridos. Espera a que la instalación se complete.

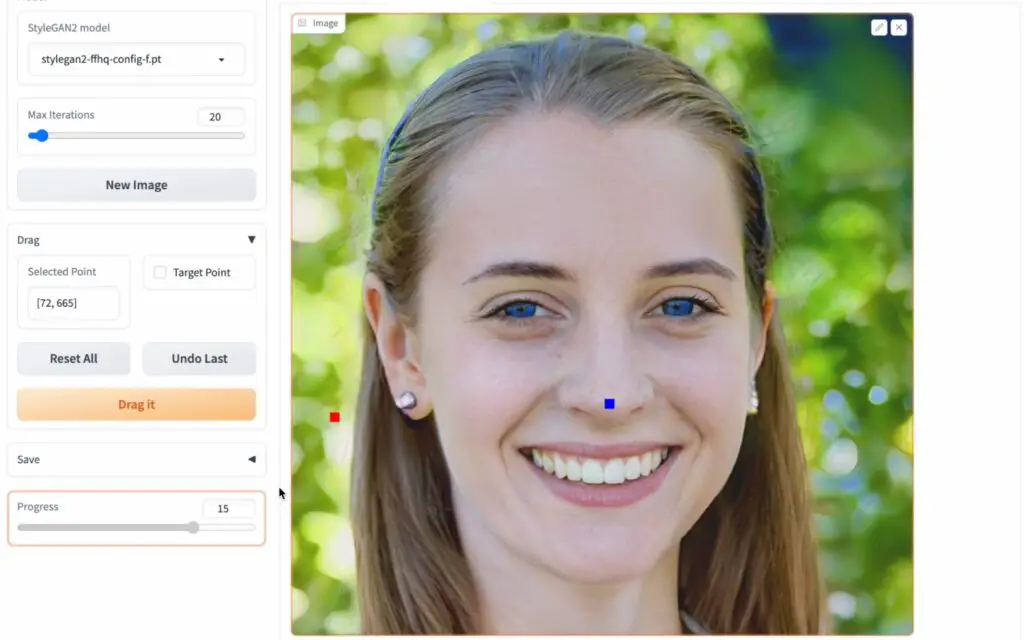

Iniciar DragGAN

Una vez que la instalación esté completa, puedes ejecutar el siguiente comando para iniciar la herramienta de edición de DragGAN utilizando Gradio.

python gradio_app.pyGradio se ejecuta en el puerto 7860 [http://localhost:7860]. Puedes crear un firewall para abrir este puerto o configurar un proxy inverso de Nginx para poder abrirlo en tu navegador sin el puerto.

Configuración de Nginx para Gradio (Opcional)

Aquí encontrarás cómo configurar un proxy inverso de Nginx para lanzar Gradio en tu navegador web sin el puerto. También puedes configurar un nombre de dominio e instalar SSL si es necesario.

Ejecuta el siguiente comando para instalar Nginx.

sudo apt install nginx

Elimina las configuraciones predeterminadas de Nginx.

sudo rm -rf /etc/nginx/sites-enabled/default

sudo rm -rf /etc/nginx/sites-available/defaultCrea una nueva configuración de Nginx para DragGAN.

sudo nano /etc/nginx/sites-available/draggan.conf

Copia y pega el código en el editor.

server {

listen [::]:80;

listen 80;

server_name YOUR_EXTERNAL_IP;

location / {

proxy_pass http://localhost:7860;

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection 'upgrade';

proxy_set_header Host $host;

proxy_cache_bypass $http_upgrade;

}

}Reemplaza YOUR_EXTERNAL_IP con tu dirección IP o nombre de dominio.

Habilita la configuración de Nginx para DragGAN.

sudo ln -s /etc/nginx/sites-available/draggan.conf /etc/nginx/sites-enabled/draggan.conf

Verifica la configuración de Nginx.

sudo nginx -t

Reinicia Nginx para que la configuración de DragGAN surta efecto.

sudo service nginx restart

Ahora puedes abrir el editor de DragGAN en tu navegador web utilizando tu dirección IP o nombre de dominio.

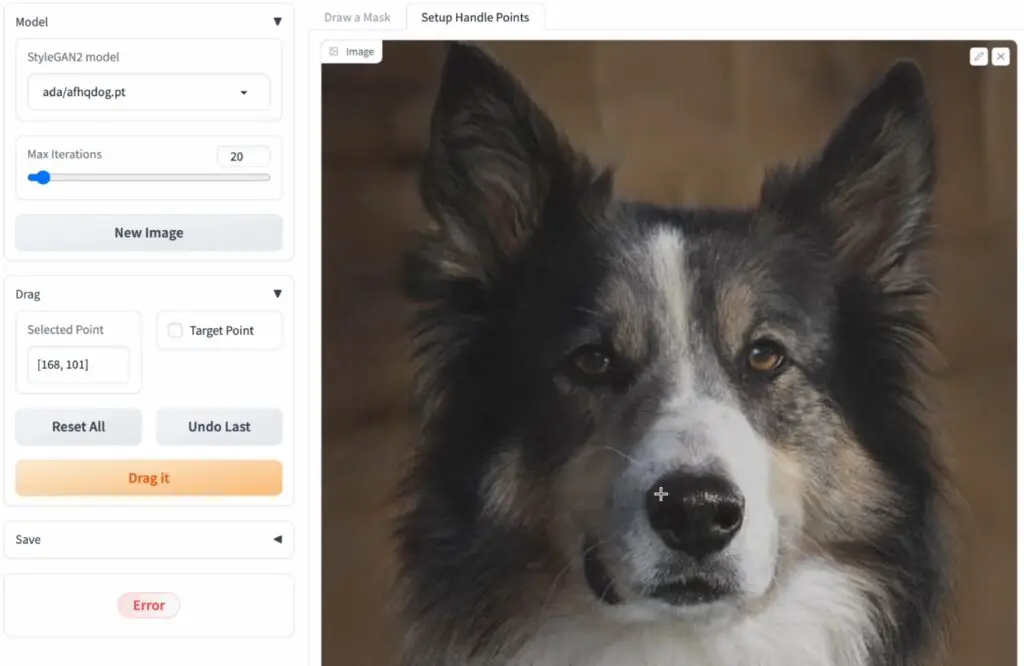

Limitaciones de usar DragGAN AI

Actualmente se encuentra en desarrollo, por lo que tiene algunas limitaciones.

- En primer lugar, la generación de imágenes puede llevar tiempo.

- En segundo lugar, ocasionalmente puede crear imágenes que no son realistas.

- En tercer lugar, DragGAN no es accesible en todos los sistemas si no se configura correctamente.

Este artículo tiene como objetivo ayudarte a aprender a configurar la herramienta de edición de DragGAN AI en Ubuntu 22.04. Esperamos que te haya sido útil. No dudes en compartir tus pensamientos y comentarios en la sección de comentarios a continuación.

Más información está disponible en el artículo, en Hugging Face o en la página del proyecto DragGAN.